-

马斯克 AI 超算细节曝光:已投资 4 亿美元,百万 GPU 电力缺口大

北京时间 4 月 2 日,埃隆・马斯 (Elon Musk) 曾表示,他的人工智能创业公司 xAI 将在美国田纳西州孟菲斯市建造世界上最大的超级计算机。《商业内幕》看到的文件显示,该公司正为此投入数亿美元,但面临较大的电力缺口。 自 2024 年 6 月该项目首次宣布以来,xAI 已经向孟菲斯规划与发展机构提交了 14 份建筑许可证申请,总预估成本为 4.059 亿美元 (约合 29 亿元人民币)…- 1.3k

-

OpenAI GPT-6 训练规模将创历史新高:预估 10 万张 H100 GPU,AI 训练成本达天文数字

3 月 1 日消息,科技媒体 smartprix 昨日(2 月 28 日)发布博文,报道称 OpenAI 在介绍 GPT-4.5 模型的视频中,意外泄露了 GPT-6 训练可能需要的 GPU 数量,暗示其规模将远超以往。 注:在 GPT-4.5 模型介绍视频的 2 分 26 秒处,OpenAI 展示 GPT 4.5 功能的聊天记录中,出现了“Num GPUs for GPT 6 Training”…- 1.9k

-

奥尔特曼坦诚 OpenAI 急缺 GPU,GPT-4.5 只能分阶段推出

2 月 28 日消息,OpenAI 首席执行官奥尔特曼今日表示,由于“GPU 资源紧缺”,公司不得不分阶段推出最新的 GPT-4.5 模型。 在 X 平台上的一篇帖子中,奥尔特曼指出,GPT-4.5 是一个“庞大”且“昂贵”的模型,需要数万个额外的 GPU 才能向更多 ChatGPT 用户开放。GPT-4.5 将首先推向 ChatGPT Pro 订阅者,随后将在下周向 ChatGPT Plus 用…- 1.4k

-

Meta CEO 扎克伯格:今年将大幅扩充 AI 团队,年底 GPU 数量将超 130 万

1 月 24 日消息,Meta 首席执行官扎克伯格当地时间 1 月 24 日在社交平台 Facebook 表示,将在 2025 年实现约 1GW 的在线计算,到年底 Meta 将拥有超过 130 万个 GPU。 扎克伯格表示,Meta 计划今年投资 600 亿至 650 亿美元(注:当前约 4371.78 亿至 4736.09 亿元人民币)用于资本支出,同时大幅发展人工智能团队。 与 Meta 去…- 1.1k

-

英国政府计划采购 10 万块 GPU,将公共部门 AI算力提升 20 倍

1 月 13 日消息,英国首相斯塔默承诺,到 2030 年英国政府将采购多达 10 万块 GPU,这意味着英国主权 AI算力将增加 20 倍,主要用于学术界和公共服务领域的 AI 应用。 据1AI了解,目前英国已拥有两台先进的超级计算机,分别是布里斯托尔大学的 Isambard-AI 和剑桥大学的 Dawn。Isambard-AI 配备了约 5000 个 GPU,这些专用芯片是构建 AI 软件的核…- 1.7k

-

IBM 全新光学技术可缩短 GPU 闲置时间,大幅加快 AI模型训练速度

12 月 11 日消息,IBM 宣布开发出一种新的光学技术,能够以光速训练 AI 模型,同时大幅节省能源。该公司表示,通过将这项突破应用于数据中心,训练一个 AI 模型所节省的能源相当于 5000 个美国家庭一年的能源消耗。 该公司解释说,虽然数据中心通过光纤电缆与外部世界连接,但内部仍然使用铜线。这些铜线连接着 GPU 加速器,而 GPU 加速器在等待来自其他设备的数据时会有大量时间处于空闲状态…- 1.2k

-

丹麦首台 AI 超级计算机 Gefion 推出,由 1528 个英伟达 H100 GPU 驱动

10 月 27 日消息,丹麦推出了该国首台 AI超级计算机,以丹麦神话中的女神 Gefion 命名,旨在推动量子计算、清洁能源、生物技术等领域取得突破,英伟达首席执行官黄仁勋与丹麦国王一同出席了揭幕仪式。 Gefion 是一台由 1528 个英伟达 H100 Tensor Core GPU 驱动的英伟达 DGX SuperPOD 超级计算机,使用英伟达 Quantum-2 InfiniBand 网…- 5.4k

-

拉里·埃里森和埃隆·马斯克在晚餐上“恳求”Nvidia的黄仁勋提供更多 GPU

在上周与分析师的会议上,亿万富翁甲骨文联合创始人兼首席技术官拉里·埃里森告诉观众,他和世界首富埃隆·马斯克带英伟达首席执行官黄仁勋到Nobu Palo Alto 共进晚餐,并“恳求”黄给他们更多 GPU。 “我会把这次晚宴形容为 Oracle——我和 Elon 向 Jensen 乞求 GPU,”埃里森回忆道。 “请拿走我们的钱。请拿走我们的钱。顺便说一句,我吃晚饭了。不不不,多吃点吧。我们需要你多…- 6.3k

-

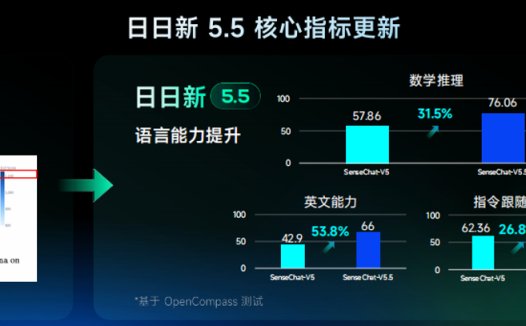

商汤科技:目前投建的国产化 AI 算力集群已拥有 5.4 万张 GPU,最高算力达 2 万 P

据界面新闻报道,在今日举办的 2024 REAL 科技大会上,商汤数字文娱事业部总经理栾青介绍称,目前商汤投建的国产化人工智能算力集群已拥有 5.4 万张 GPU,最高算力达 2 万 P。 栾青表示,商汤正在上海临港投建全国最大规模人工智能数据中心,全国算力节点遍及上海、广州、重庆、深圳、福州等地。 据IT之家此前报道,商汤截至 2024 年 6 月 30 日的半年报数据显示,2024 年上半年,…- 5.4k

-

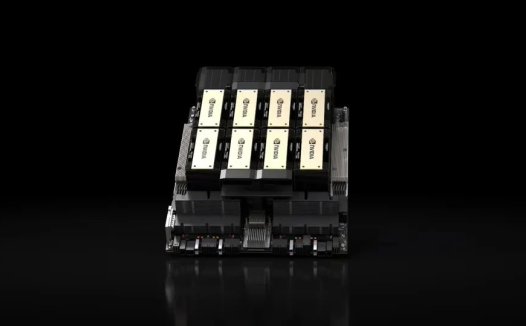

Meta 训练 Llama 3 遭遇频繁故障,16384 块 H100 GPU 训练集群每 3 小时“罢工”一次

Meta 发布的一份研究报告显示,其用于训练 4050 亿参数模型 Llama 3 的 16384 个英伟达 H100 显卡集群在 54 天内出现了 419 次意外故障,平均每三小时就有一次。其中,一半以上的故障是由显卡或其搭载的高带宽内存(HBM3)引起的。 由于系统规模巨大且任务高度同步,单个显卡故障可能导致整个训练任务中断,需要重新开始。尽管如此,Meta 团队还是保持了 90% 以上的有效…- 6k

-

云计算公司Lambda推出按需获取Nvidia H100 GPU的全新集群服务

最近,GPU 云计算公司 Lambda 宣布推出其全新的1-Click 集群服务,客户现在可以按需获取 Nvidia H100GPU 和 Quantum2InfiniBand 集群。这一创新服务使得企业能够仅在需要的时候获得计算能力,尤其适合那些不需要24小时全天候使用 GPU 的公司。 图源备注:图片由AI生成,图片授权服务商Midjourney Lambda 的联合创始人兼副总裁 Robert…- 3.1k

-

Grok2即将发布 xAI加速AI竞赛:10万GPU超算本月底交付

马斯克于7月9日宣布,其人工智能公司xAI正在打造一台拥有10万块英伟达H100GPU的超级计算机,预计将于本月底交付并开始训练。这一举措标志着xAI终止了与甲骨文扩大现有协议、租用更多英伟达芯片的洽谈。 马斯克强调,这将成为"全球范围内功能最强大的训练集群,并且领先优势巨大"。他表示,xAI的核心竞争力在于速度,"这是缩小差距的唯一途径"。 在此之前,xA…- 6.6k

-

世界最大开源 AI 社区 Hugging Face 将免费提供 1000 万美元共享 GPU,帮助小企业对抗大公司

世界最大的开源 AI社区 Hugging Face(通称“抱抱脸”)日前宣布,将提供 1000 万美元的免费共享 GPU 帮助开发者创造新的 AI 技术。 具体来看,Hugging Face 这次做出此举的目的是帮助小型开发者、研究人员和初创公司对抗大型 AI 公司,避免 AI 进步陷入“集中化”。 Hugging Face 首席执行官 Clem Delangue 在接受 The Verge 采访…- 2.8k

-

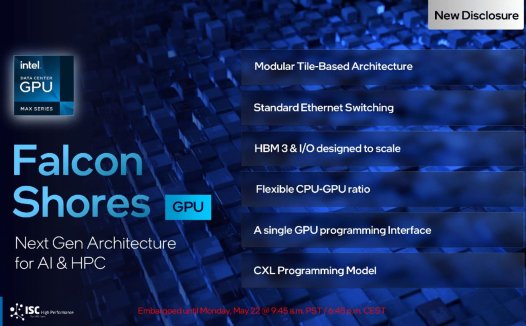

英特尔 Falcon Shores GPU 明年晚些时候推出,已为 AI 负载重构

英特尔在上月末举行的一季度电话财报会议上明确,Falcon Shores GPU 将于 2025 年晚些时候推出。另据外媒 HPCwire 报道,该处理器正重新设计,以适应 AI 产业需求。 英特尔 CEO 帕特・基辛格称,Falcon Shores 将结合完全可编程的架构和 Gaudi 3 加速器优异的系统性能,用户可在两代硬件间实现顺利且无缝的升级转换。 英特尔表示,AI 业界正转向 Pyth…- 2k

-

北京:将对采购自主可控 GPU 芯片开展智能算力服务的企业,按投资额一定比例给予支持

北京市经济和信息化局、北京市通信管理局 24 日发布《北京市算力基础设施建设实施方案(2024—2027 年)》。 《实施方案》提出,到 2027 年,优化京津冀蒙算力供给质量和规模,力争自主可控算力满足大模型训练需求,算力能耗标准达到国内领先水平。重点任务方面,包括推进算力产业自主创新、构建高效算力供给体系、推动京津冀蒙算力一体化建设、提升智算中心绿色低碳水平、深化算力赋能行业应用、保障算力基础…- 3.9k

-

英伟达 H100 AI GPU 短缺缓解,交货时间从 3-4 个月降至 2-3 个月

曾几何时,英伟达用于人工智能计算的 H100 GPU 供不应求。然而据 Digitimes 报道,台积电的台湾地区总经理 Terence Liao 表示,过去几个月英伟达 H100 的交货等待时间已经大幅缩短,从最初的 3-4 个月降至目前的 2-3 个月(8-12 周)。服务器代工厂商也透露,相比 2023 年几乎无法买到英伟达 H100 的情况,目前供应瓶颈正在逐步缓解。 尽管交货等待时间有所…- 6.6k

-

据称Stability AI资金告急,无法支付租用的云GPU账单

生成式AI明星 Stability AI 的热门文本到图像生成模型 Stable Diffusion 所需的大规模 GPU 集群似乎也部分导致了前首席执行官 Emad Mostaque 的失败 - 因为他找不到支付这些 GPU 的方法。 根据引用公司文件和数十位知情人士的详尽报道,据称这家英国模型构建公司的极高基础设施成本耗尽了公司的现金储备,导致截至去年十月时,公司只剩下400万美元。 Stab…- 4.4k

-

AI明星创业公司买英伟达GPU ,几周估值翻倍,但花的钱比赚的多17倍

在AI行业,尤其是生成式AI领域,技术的快速发展和应用的广泛前景吸引了大量的投资和关注。然而,这一领域的高昂成本也引起了业界的广泛讨论。最近,《华尔街日报》的一篇报道指出,AI行业的公司在购买英伟达GPU上的投入是其收入的17倍,这一数字令人震惊,同时也引发了对行业未来发展的深入思考。 AI初创公司Cognition Labs,由知名投资人Peter Thiel支持,正在寻求20亿美元的估值,其估…- 2k

-

英伟达 AI芯片 H200 开始供货,性能相比 H100 提升 60%-90%

3 月 28 日消息,据日本经济新闻今日报道,英伟达的尖端图像处理半导体(GPU)H200 现已开始供货。H200 为面向 AI 领域的半导体,性能超过当前主打的 H100。 根据英伟达方面公布的性能评测结果,以 Meta公司旗下大语言模型 Llama 2 处理速度为例,H200 相比于 H100,生成式 AI 导出答案的处理速度最高提高了 45%。 市场调研机构 Omdia 曾表示,2022 年…- 3.5k

-

英伟达发布AI Enterprise5.0,助力企业生成式AI开发

英伟达正式发布了AI Enterprise5.0,这是一项旨在帮助企业加速生成式人工智能(AI)开发的重要产品。AI Enterprise5.0包含了英伟达微服务和可下载的软件容器,这些组件可用于部署生成式AI应用程序和加速计算。值得一提的是,这一产品已经被Uber等知名客户所采用。 随着开发人员转向微服务作为构建现代企业应用程序的有效方式,NVIDIA AI Enterprise5.0提供了广泛…- 2.8k

-

英伟达洽谈收购以色列人工智能公司Run:ai

据知情人士透露,英伟达目前正与以色列的人工智能基础设施编排和管理平台Run: AI进行深入谈判,商讨收购事宜。此次交易的价值预计将达到数亿美元,甚至有可能攀升至10亿美元的高位。 目前,双方谈判仍在进行中,具体的收购细节和条件尚未公开。 Run:ai 是一家专门针对 GPU 的 AI 优化和编排平台。 Run:ai 提供了一系列工具和功能,包括 CLI 和 GUI、工作区、开源框架、指标、资源管理…- 3.9k

-

CPU、GPU、NPU,究竟谁才是“AI PC”的主角?

众所周知,如今“AI PC”可以说是消费电子行业最为热门的话题之一。对于一些不太了解技术细节,但却对这个概念心向往之的消费者而言,他们相信“AI PC”可以更智能地帮助自己完成一些不熟练的操作,或是减轻日常工作的负担。 但对于像我们这样,对“AI PC”既抱有极高期待、但同时又相对比较了解的用户来说。很多时候思考的其实是AI PC早就出现了,可为什么到现在才被真正推行起来? AI PC到底有多早?…- 2.9k

-

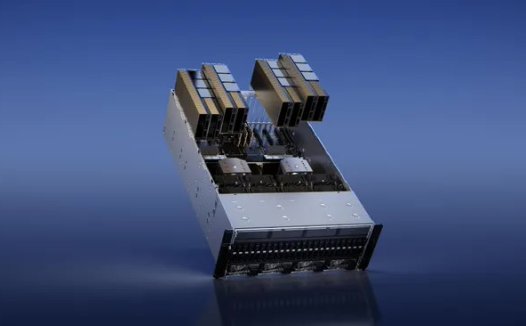

Meta 新建两座数据中心集群:内含超 4.9 万块英伟达 H100 GPU,专门训练 Llama3

Meta 公司当地时间 12 日通过官方新闻稿公布了两座新的数据中心集群,该公司正希望通过英伟达的 GPU,在以 AI 为重点的开发中脱颖而出。 据悉,这两座数据中心的唯一目的,是在消费者特定应用领域(IT之家注:包含声音或图像识别)中进行 AI 研究和大语言模型的开发,每个集群都包含了 24576 块英伟达 H100 AI GPU,将用于自家大语言模型 Llama 3 的训练。 两座新建的数据中…- 3.3k

-

Meta投资人工智能推动视频推荐 融合Feed和Reels

Facebook母公司Meta正大力投资人工智能技术,作为其"到2026年的技术路线图"的一部分,旨在开发全新的人工智能推荐模型为其所有视频产品做推荐,包括类似TikTok的Reels短视频服务和Facebook Feed中的传统长视频。 Meta高管Tom Alison透露,该公司目前通常为每种产品如Reels、Groups和主Feed使用单独的推荐模型,但未来将开发出一个统…- 3.3k