-

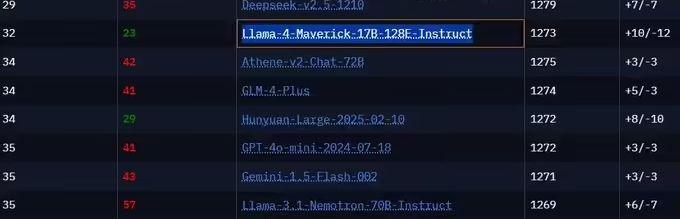

Meta 开源大模型 Llama-4-Maverick 基准测试排名暴跌,此前被质疑刷榜作弊

4 月 14 日消息,LMArena 更新了 Meta 最新发布的开源大模型 Llama-4-Maverick 的排名,其从此前的第 2 名直线下降至第 32 名。这证实了此前开发者对 Meta 为刷榜向 LMArena 提供“特供版”Llama 4 大模型的质疑。 4 月 6 日,Meta 发布了最新的大模型 Llama 4,包含 Scout、Maverick 和 Behemoth 三个版本。其…- 1.7k

-

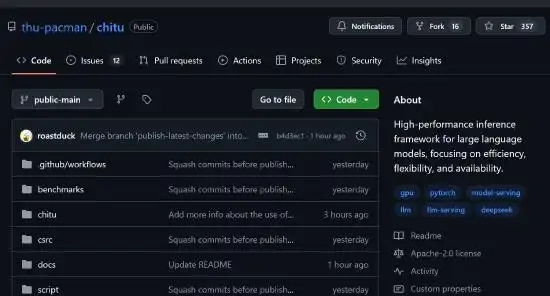

清华团队开源大模型推理引擎“赤兔 Chitu”,实现 DeepSeek 推理成本降低一半、性能翻番

3 月 14 日消息,清华大学高性能计算研究所翟季冬教授团队、清华系科创企业清程极智今日联合宣布,大模型推理引擎“赤兔 Chitu”现已开源。 据介绍,该引擎首次实现在非英伟达 Hopper 架构 GPU 及各类国产芯片上原生运行 FP8 精度模型,实现 DeepSeek 推理成本降低一半、性能翻番。其定位为“生产级大模型推理引擎”,提供如下特性: 多元算力适配:不仅支持 NVIDIA 最新旗舰到…- 8.5k

-

阿里千问(Qwen)衍生模型数量破 10 万,位居全球开源模型榜首

2 月 25 日消息,据科创板日报今日报道,全球最大 AI 开源社区 Hugging Face 数据显示,截至目前,阿里千问(Qwen)开源大模型的衍生模型数量已突破 10 万,持续领先美国 Llama 等开源模型,稳居全球最大开源模型榜首。 自 2023 年 8 月起,阿里云相继开源 Qwen、Qwen1.5、Qwen2、Qwen2.5 等 4 代模型,囊括了 0.5B、1.5B、3B、7B、1…- 3.1k

-

元象发布中国最大 MoE 开源大模型:总参数 255B,激活参数 36B

元象 XVERSE 发布中国最大 MoE 开源模型 XVERSE-MoE-A36B。 该模型总参数 255B,激活参数 36B,官方号称效果能“大致达到”超过 100B 大模型的“跨级”性能跃升,同时训练时间减少 30%,推理性能提升 100%,使每 token 成本大幅下降。 MoE(Mixture of Experts)混合专家模型架构,将多个细分领域的专家模型组合成一个超级模型,在扩大模型规…- 9k

-

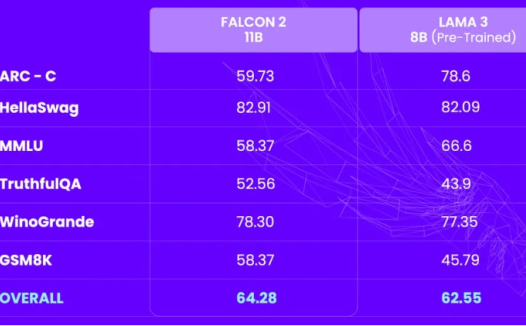

超越Llama 3的性能怪兽:Falcon 2开源大模型,商用AI的新标杆

在AI领域,一股新的力量正在崛起。阿布扎比技术创新研究所(TII)宣布开源他们的全新大模型Falcon2,一个拥有110亿参数的模型,它以出色的性能和多语言能力,引起了全球的关注。 Falcon2有两个版本,一个基础版,易于部署,能够生成文本、代码和总结;另一个是带有视觉转换功能的VLM模型,能够将图片信息转换成文本,这在开源大模型中极为罕见。在多个维权测试排行榜中,Falcon211B的性能超越…- 8.3k

-

全球首个芯片设计开源大模型SemiKong正式发布 性能超越通用大模型

全球首个芯片设计开源大模型SemiKong正式发布,它基于Llama3微调而来,性能超越了通用大模型。这不仅是技术的突破,更是开源精神的胜利,预示着未来五年内,5000亿美元的半导体行业将迎来翻天覆地的变化。 SemiKong的问世,标志着AI在芯片设计领域的应用迈出了坚实的一步。它由Aitomatic与FPT Software联手打造,在Semicon West2024大会上首次亮相,便引起了业…- 10.9k

-

腾讯混元文生图开源大模型加速库发布:生图时间缩短 75%

腾讯发布针对腾讯混元文生图开源大模型(混元 DiT)的加速库,号称大幅提升推理效率,生图时间缩短 75%。 官方表示,混元 DiT 模型的使用门槛也大幅降低,用户可以基于 ComfyUI 的图形化界面使用腾讯混元文生图模型能力。同时,混元 DiT 模型已经部署至 HuggingFaceDiffusers 通用模型库中,用户仅用三行代码即可调用混元 DiT 模型,无需下载原始代码库。 在此之前,腾讯…- 3.9k

-

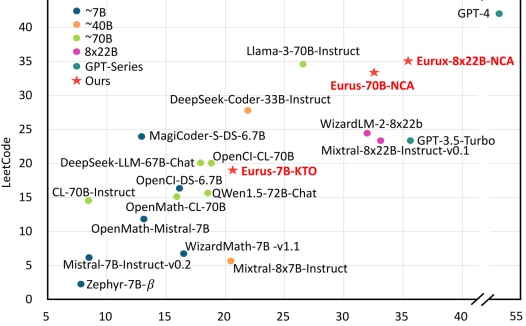

面壁智能发布 Eurux-8x22B 开源大模型:代码性能超越 Llama3-70B

面壁智能发布开源大模型 Eurux-8x22B,包括 Eurux-8x22B-NCA 与 Eurux-8x22B-KTO,主打推理能力。 官方测试中,Eurux-8x22B 在 LeetCode(180 道 LeetCode 编程真题)与 TheoremQA (IT之家注:美国大学水准的 STEM 题目)测试上超越了 Llama3-70B,在 LeetCode 测试上超越闭源的 GPT-3.5-T…- 4.6k

-

百度智能云宣布支持Llama3全系列训练推理

4月19日,百度智能云千帆大模型平台在国内首家推出针对Llama3全系列版本的训练推理方案,便于开发者进行再训练,搭建专属大模型,现已开放邀约测试。 目前,百度智能云千帆大模型平台中各种尺寸模型定制工具ModelBuilder已预置了最全面最丰富的大模型,支持国内外第三方主流模型,总数量达到79个,是国内拥有大模型数量最多的开发平台。 据悉,4月18日,Meta 正式发布 Llama3,包括8B …- 4.9k

-

7B超越百亿级,北大开源aiXcoder-7B最强代码大模型,企业部署最佳选择

当下,大语言模型集成至编程领域、完成代码生成与补全任务成为重要趋势。业界已经出现了一批引人瞩目的代码大模型,比如 OpenAI 的 CodeX、谷歌 DeepMind 的 AlphaCode、HuggingFace 的 StarCoder,帮助程序员更迅捷、更准确、更高质量地完成编码任务,大幅提升效率。 有这样一支研发团队,在10年前便开始了将深度学习用于软件开发的探索,并在代码理解和代码生成领域…- 5.2k

-

Meta即将推出新一代Llama3大语言模型

据外媒报道,Meta Platforms公司计划在下周推出Llama3大语言模型(LLM)的两个小参数版本,作为即将在2024年夏天推出的Llama3最大版本的前奏。 据悉,Llama3最高版本可能拥有超过1400亿个参数,这将使其性能有望赶上OpenAI最新的GPT-4Turbo版本。不过,Meta下周公布的版本暂不支持多模态技术。 这一消息可能会引发人们对Llama3的强烈期待。去年7月,Ll…- 3.4k

-

开源大模型DBRX:1320亿参数,比Llama2-70B快1倍

大数据公司Databricks最近发布了一款名为DBRX的MoE大模型,引发了开源社区的热议。DBRX在基准测试中击败了Grok-1、Mixtral等开源模型,成为了新的开源之王。这款模型的总参数量达到了1320亿,但每次激活只有360亿参数,并且其生成速度比Llama2-70B快1倍。 DBRX是由16个专家模型组成,每次推理有4个专家处于激活状态,上下文长度为32K。为了训练DBRX,Data…- 3.4k

-

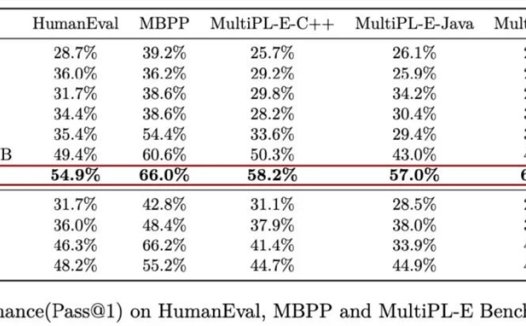

李开复旗下 AI 公司零一万物宣布开源 Yi-9B 模型,号称同系列代码、数学能力最强

“零一万物 01AI”官方公众号今晚发文宣布开源 Yi-9B 模型,官方称其为 Yi 系列模型中的“理科状元”——Yi-9B 是目前 Yi 系列模型中代码和数学能力最强的模型,实际参数为 8.8B,默认上下文长度为 4K tokens。 该模型是在 Yi-6B (使用了 3.1T tokens 训练)的基础上,使用了 0.8T tokens 进行继续训练,数据截至 2023 年 6 月。 据介绍,…- 4.8k

-

国内规模最大!阿里巴巴CEO吴泳铭:即将开源720亿参数大模型

11月10日消息,在昨天举行的2023年世界互联网大会乌镇峰会互联网企业家论坛”上,阿里巴巴集团CEO吴泳铭发表了讲话。 吴泳铭表示,阿里巴巴即将开源720亿参数大模型,这将是国内参数规模最大的开源大模型。 这已经不是阿里首次开源大模型了,在今年8月份,阿里上架了两款开源模型Qwen-7B和Qwen-7B-Chat,分别是通义千问70亿参数通用模型和对话模型。 今年9月份,阿里又开源了通义千问14…- 3.5k

❯

搜索

扫码打开当前页

返回顶部

幸运之星即将降临……

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠

-

¥優惠使用時效:无法使用使用時效:

之前

使用時效:预期有效优惠编号:×

没有优惠可用!