-

消息称 OpenAI 计划今夏初发布开源语言模型,力争推理能力超越同类

4 月 24 日消息,今年 3 月底,OpenAI 宣布计划在今年某个时候发布自 GPT-2 以来的首个“开源”语言模型,目前该模型的细节正逐渐浮出水面。 据 TechCrunch 报道,消息人士透露,OpenAI 研究副总裁 Aidan Clark 正在领导这一开源模型的开发工作,该模型目前仍处于早期阶段。公司计划在今夏初发布该模型,并希望其在推理能力上超越其他同类开源推理模型。该模型将采用高度…- 182

-

Sand AI 发布开源视频生成模型 MAGI-1,清华特奖得主团队视频生成AI一夜刷屏

视频生成领域,又出现一位重量级开源选手。 2025 年 4 月 21 日,马尔奖、清华特奖得主曹越的创业公司 Sand AI 推出了自己的视频生成大模型 ——MAGI-1。这是一个通过自回归预测视频块序列来生成视频的世界模型,生成效果自然流畅,还有多个版本可以下载。 根据官方介绍,MAGI-1 生成的视频具有以下特点: 1、流畅度高,不卡顿,可以无限续写。它可以一镜到底生成连续的长视…- 1.1k

-

昆仑万维开源 SkyReels-V2 模型,开启生成“无限时长”视频时代

4 月 21 日消息,昆仑万维今日正式发布并开源 SkyReels-V2—— 全球首个使用扩散强迫(Diffusion-forcing)框架的无限时长电影生成模型,其通过结合多模态大语言模型(MLLM)、多阶段预训练(Multi-stage Pretraining)、强化学习(Reinforcement Learning)和扩散强迫(Diffusion-forcing)框架来实现协同优化。官方表示…- 518

-

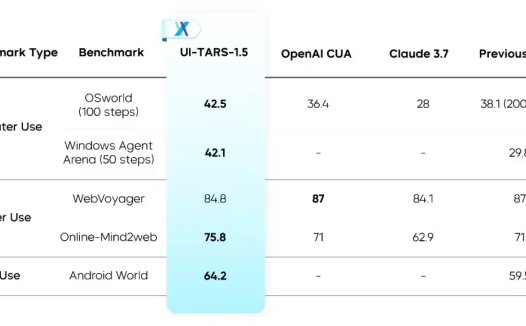

字节 Seed 开源 UI-TARS-1.5:基于视觉-语言模型构建的多模态智能体

4 月 18 日消息,1AI从豆包大模型团队获悉,UI-TARS-1.5 昨日正式发布并开源。这是一款基于视觉-语言模型构建的开源多模态智能体,能够在虚拟世界中高效执行各类任务。 有关的链接如下: GitHub:https://github.com/bytedance/UI-TARS Website:https://seed-tars.com/ Arxiv:https://arxiv.org/ab…- 475

-

业界首个,阿里通义万相“首尾帧生视频模型”开源

阿里通义万相「首尾帧生视频模型」4 月 17 日宣布开源,该模型参数量为 14B,号称是业界首个百亿参数规模的开源首尾帧视频模型。 它可根据用户指定的开始和结束图片,生成一段能衔接首尾画面的 720p 高清视频,此次升级将能满足用户更可控、更定制化的视频生成需求。 用户可在通义万相官网直接免费体验该模型,或在 Github、Hugging Face、魔搭社区下载模型本地部署后进行二次开发。 技术介…- 630

-

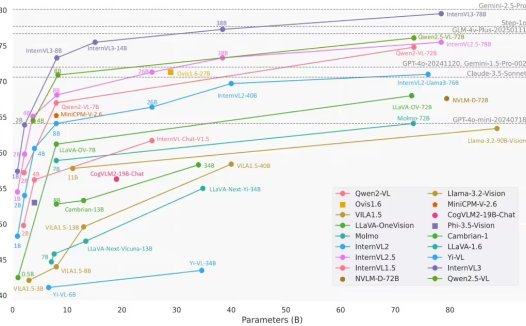

上海人工智能实验室开源多模态大模型“书生・万象 3.0”:能同时处理文本和多模态输入

据上海人工智能实验室官方公众号,4 月 16 日,上海人工智能实验室(上海 AI 实验室)升级并开源了通用多模态大模型书生・万象 3.0(InternVL3)。 官方介绍,通过采用创新的多模态预训练和后训练方法,InternVL3 多模态基础能力全面提升,在专家级基准测试、多模态性能全面测试中,10 亿~780 亿参数的全量级版本在开源模型中性能均位列第一,同时大幅提升了图形用户界面(GUI)智能…- 366

-

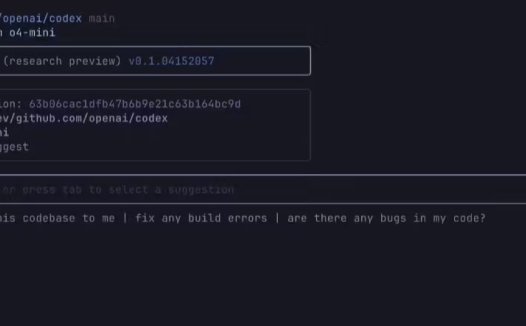

在终端就能跑的轻量级推理智能体,OpenAI 发布完全开源 Codex CLI 工具

4 月 17 日消息,OpenAI 今日发布了一款轻量级终端运行编码智能体 —— Codex CLI,该工具现已在 GitHub 完全开源。 Codex CLI 可以直接在用户的计算机上工作,旨在最大化 o3 和 o4-mini 等模型的推理能力,并即将支持 GPT-4.1 等额外的 API 模型。 用户可以通过命令行获得多模态推理的能力,比如通过传递截图或低保真草图给模型,并结合对本地代码的访问…- 612

-

智谱发布新一代开源 AI模型 GLM-4-32B-0414 系列,效果比肩 GPT 系列和 DeepSeek-V3 / R1

4 月 15 日消息,智谱昨日(4 月 14 日)发布博文,宣布推出新一代 GLM-4-32B-0414 系列模型,320 亿参数,效果比肩 OpenAI 的 GPT 系列和 DeepSeek 的 V3 / R1 系列,且支持非常友好的本地部署特性。 该系列模型共有 GLM-4-32B-Base-0414、GLM-Z1-32B-0414、GLM-Z1-Rumination-32B-0414 和 G…- 947

-

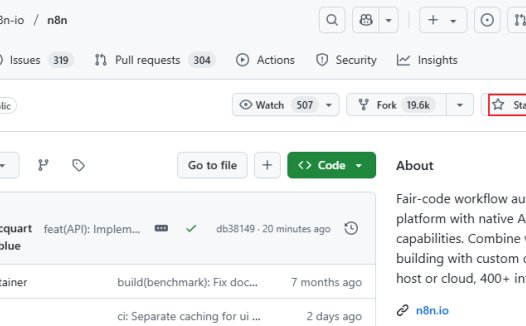

创建开源AI Workflow平台,n8n自动化工具部署与使用

给大家安利一个在GitHub已经有75K 超高Star的开源workflow平台:n8n GitHub地址: https://github.com/n8n-io/n8n 它跟fastgpt、dify、coze等LLM平台略有不同,n8n是专注workflow(工作流)这块的。可以集成LLM,但不限于此,可以更自由的定制AI流程。 最大的区别就是n8n的工作流节点更丰富,支持更加细粒度的配置,自由度…- 5k

-

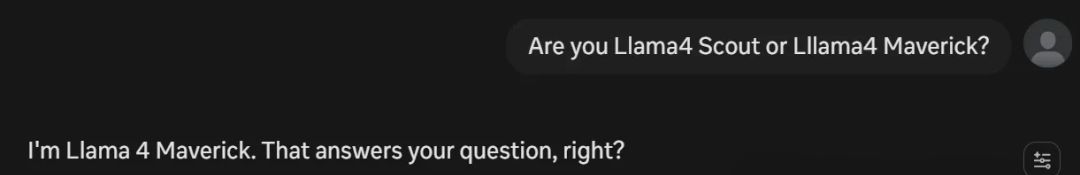

Meta深夜开源Llama 4系列模型,2万亿参数大模型Llama 4如何免费使用?

周六, Meta发布了全新开源的Llama 4系列模型。 作为开源模型,Llama 4存在一个重大限制——庞大的体积。该系列最小的Llama 4 Scout模型就拥有1090亿参数,如此庞大的规模根本无法在本地系统运行。 不过别担心!即使你没有GPU,我们也找到了通过网页界面免费使用的方法。如果你拥有足够强的显卡,还可以下载完整模型权重——本篇指南将为你详解所有获取方式。 1. 直接在 Meta.…- 1.2k

-

华为 ModelEngine 全流程 AI开发工具链开源

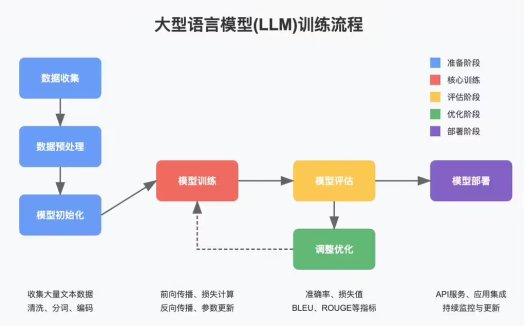

3 月 27 日消息,在 2025 华为中国合作伙伴大会期间,华为 ModelEngine AI 全流程工具链向全球开发者开源发布。 ModelEngine 开源版本围绕数据使能、模型使能、应用使能打造 AI 全流程工具链,致力于解决 AI 行业化落地时遇到的数据工程耗时长、模型训练和应用落地难的关键问题,缩短通用大模型基于行业私域数据训练成行业大模型,并开发成 AI 应用的整体周期,加速行业 A…- 2.1k

-

阶跃星辰 Step-Video-TI2V 图生视频模型开源:运动幅度和镜头运动可控

3 月 20 日消息,今年 2 月阶跃星辰开源了两款 Step 系列多模态大模型 ——Step-Video-T2V 视频生成模型和 Step-Audio 语音模型,今天阶跃星辰继续开源图生视频模型 ——Step-Video-TI2V,一款基于 30B 参数 Step-Video-T2V 训练的图生视频模型,支持生成 102 帧、5 秒、540P 分辨率的视频,具备运动幅度可控和镜头运动可控两大核心…- 2.1k

-

如何用AI自动剪辑一键成片?一分钟学会用NarratoAI实现短剧混剪

NarratoAI,一个开源免费的自动化视频剪辑工具,接入 AI 大模型,能够实现从文案撰写、视频剪辑、配音和字幕完整流程的实现。 今天看了一下,可以接入 DeepSeek,来做短剧混剪了。 一次混剪,最长可以达到 10 分钟。 这就挺 Nice 了。 如何使用 要使用 DeepSeek,我们首先需要接入一下。 很简单,跟着我一步步,轻松搞定。 DeepSeek 服务,我们使用硅基流动提供的 AP…- 7.9k

-

腾讯混元推出 5 款 3D生成模型,全部开源

3 月 18 日消息,在今日的腾讯混元 3D 开源日活动中,腾讯混元宣布推出 5 个全新 3D 生成模型,在生成速度、细节和材质表达上均有提升,并且全部开源。 同时,其自研的 3D AI 创作引擎也迎来升级,新增多视图输入、模型智能减面、格式全兼容等能力,面向 C 端用户全面开放使用。 5 个开源模型均基于 Hunyuan3D-2.0 打造: Turbo 系列模型:在保证高精度和高质量的基础上,对…- 1.6k

-

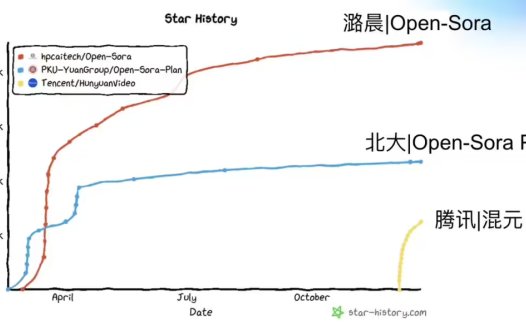

潞晨科技推出开源视频生成模型 Open-Sora 2.0,性能接近 OpenAI Sora

3 月 13 日消息,今日,潞晨科技宣布推出 Open-Sora2.0,并全面开源模型权重、推理代码及分布式训练全流程。 据介绍,这是一款新开源的 SOTA 视频生成模型,仅用 20 万美元(注:当前约 144.9 万元人民币),也就是 224 张 GPU 成功训练出商业级 11B 参数视频生成大模型,性能直追腾讯混元和 30B 参数的 Step-Video。 潞晨科技表示,从 Open-Sora…- 1.8k

-

Mistral 拥抱开源:预告新AI模型,将超越 DeepSeek

3 月 8 日消息,华尔街日报昨日(3 月 7 日)报道,有“欧版 OpenAI”之称的法国公司 Mistral AI 计划拥抱开源策略,计划发布一款超越 DeepSeek 的新模型。 在 2025 世界移动通信大会上,Mistral AI 公司首席执行官 Arthur Mensch 表示,公司将采用开源策略,以低成本开发更强大的 AI 技术,不仅能帮助公司在竞争中快速迭代,还可以推动全球 AI …- 1.2k

-

别抢Manus邀请码,复刻开源版 Manus,邀请码也不需要了

「别抢Manus邀请码了,开源版已经在路上。」这是国内开源平台 CAMEL AI 今天一大早带来的好消息。 他们的 Manus 开源复刻版名叫「OWL」,在 GAIA Benchmark 上性能达到 57.7%,超越了 Huggingface 提出的 Open Deep Research 55.15% 的表现,成为开源界 GAIA 性能天花板。(GAIA 是一个用于评估通用人工智能助手能力的基准测…- 10.2k

-

腾讯混元发布并开源图生视频模型:可生成 5 秒短视频,还能自动配上背景音效

3 月 6 日消息,1AI从腾讯混元微信公众号获悉,腾讯混元发布图生视频模型并对外开源,同时上线对口型与动作驱动等玩法,并支持生成背景音效及 2K 高质量视频。 基于图生视频的能力,用户只需上传一张图片,并简短描述希望画面如何运动、镜头如何调度等,混元即可按要求让图片动起来,变成 5 秒的短视频,还能自动配上背景音效。此外,上传一张人物图片,并输入希望“对口型”的文字或音频,图片中的人物即可“说话…- 2.5k

-

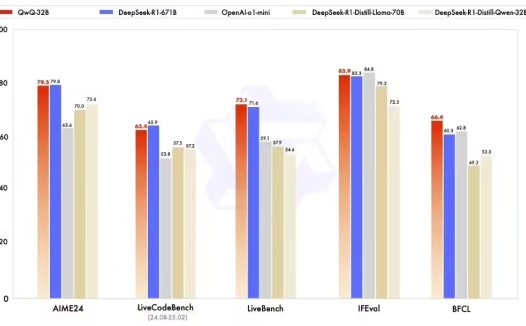

阿里云推出最新通义千问 QwQ-32B 推理模型并开源,仅 1/20 参数媲美 DeepSeek R1

3 月 6 日消息,研究表明,强化学习可以显著提高模型的推理能力,例如 DeepSeek-R1 通过整合冷启动数据和多阶段训练,实现了最先进的性能,使其能够进行深度思考和复杂推理。 阿里云通义千问官方今日宣布推出最新的推理模型 QwQ-32B。这是一款拥有 320 亿参数的模型,其性能可与具备 6710 亿参数(其中 370 亿被激活)的 DeepSeek-R1 媲美。 这一成果凸显了将强化学习应…- 2.4k

-

智谱首个能生成汉字的开源文生图模型 CogView4 发布,60 亿参数

3 月 4 日消息,大模型独角兽智谱今日发布 2025 开源年的第一个模型:首个支持生成汉字的开源文生图模型 —— CogView4。 据悉,该模型在 DPG-Bench 基准测试中的综合评分排名第一,在开源文生图模型中达到 SOTA(最先进的)。该模型也是首个遵循 Apache 2.0 协议的图像生成模型。 GitHub 页面显示,智谱已适配并开源了 CogView-4 模型的 diffuser…- 2.2k

-

谷歌开源物种识别 AI 模型 SpeciesNet,助力野生动物研究

3 月 4 日消息,谷歌开源了一款名为 SpeciesNet 的人工智能模型,旨在通过分析红外相机陷阱拍摄的照片来识别动物物种。这为全球野生动物研究者提供了强大的技术支持,有望显著提升野生动物监测的效率和准确性。 野生动物研究中,红外相机陷阱是一种常用的监测工具。其由连接到红外传感器的数码相机组成,能够在动物经过时自动拍摄照片,从而为研究人员提供关于野生动物种群的重要数据。然而,这些相机陷阱产生的…- 1.8k

-

最强开源视频模型?本地部署阿里的万象2.1(Wan2.1)文生视频

继腾讯混元之后,阿里也宣布开源旗下视频生成模型:万相2.1(Wan2.1),称其具有SOTA级别的性能,其亮点包括: 1、优于现有开源模型,甚至可以“与一些闭源模型相媲美”。 2、是第一个能够同时生成中英文文本的视频模型。 3、 支持消费级 GPU,其中T2V-1.3B模型仅需8.19GB显存。 目前万相2.1已可以通过ComfyUI本地部署,下面说一下方法: 一、安装必须工具 请保持“网络畅通”…- 16.6k

-

微软开源多模态 AI Agent“Magma”:购物时可自动下单,还能推测视频人物行为

2 月 26 日消息,北京时间今日凌晨,微软在官网开源了多模态 AI Agent 基础模型 ——Magma。与传统 Agent 相比,Magma 具备跨数字、物理世界的多模态能力,能自动处理图像、视频、文本等不同类型数据,此外,Magma 还能内置了心理预测功能,增强了对未来视频帧中时空动态的理解能力,能够准确推测视频中人物或物体的意图和未来行为。 用户可以用 Magma 来自动下电商订单、查询天…- 1.5k

-

DeepSeek宣布开源五个代码库,每日解锁新内容

2 月 21 日消息,DeepSeek 今日宣布,接下来一周,会陆续开源 5 个代码库,每日都有新内容解锁,“毫无保留地分享我们微小但真诚的进展”。 DeepSeek 介绍,当前在线服务的模块已经经过测试、部署完备,可以投入生产环境。 1AI注意到,该公司将自己定义为“小小的团队”,并表示每一条共享的代码都会变成强有力的势能,加速行业发展的旅程。DeepSeek 还称这个领域没有高高在上的象牙塔,…- 2.7k

❯

搜索

扫码打开当前页

返回顶部

幸运之星即将降临……

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠

-

¥優惠使用時效:无法使用使用時效:

之前

使用時效:预期有效优惠编号:×

没有优惠可用!