-

腾讯微信正式发布多模态大模型 POINTS 1.5

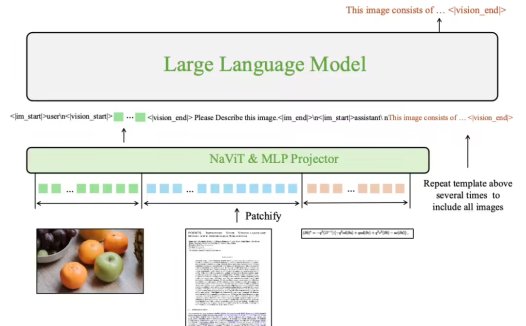

距离 POINT1.0 的发布已经过去两个月的时间,腾讯12 月 14 日宣布推出 POINTS1.5。 1AI注意到,POINTS1.5 仍然沿用了 POINTS1.0 中使用的经典的 LLaVA 架构,由一个 vision encoder,一个 projector 和一个大语言模型组成。 据官方介绍,这一代 POINTS 模型,不仅兼顾了 POINTS1.0 中所坚持的效率优先的思想,同时极…- 2.8k

-

微软亚洲研究院与上海市精神卫生中心展开联合研究,借助多模态大模型为认知障碍患者带来全新训练方法

据微软亚洲研究院官方披露,该研究院与上海市精神卫生中心携手展开联合研究,基于微软 Azure OpenAI 服务中的多模态大模型,开发了利用多种模态数据(如语音、文字、图片、音乐等信息)的个性化认知训练框架,为认知障碍患者的认知训练带来了新的可能。 从微软亚洲研究院获悉,综合上海市精神卫生中心专家的建议与患者的需求,微软亚洲研究院的研究员们从易用性、界面友好性、功能专业性和入门难易度等多个维度出发…- 6.3k

-

Pixtral 12B 发布:Mistral开源首个多模态AI大模型

科技媒体 TechCrunch 昨日(9 月 11 日)报道,法国 AI 初创公司 Mistral 发布 Pixtral 12B,是该公司首款能够同时处理图像和文本的多模态 AI大语音模型。 Pixtral 12B 模型拥有 120 亿参数,大小约为 24GB,参数大致对应于模型的解题能力,拥有更多参数的模型通常比参数较少的模型表现更优。 Pixtral 12B 模型基于文本模型 Nemo 12B…- 7.5k

-

云知声推出山海多模态大模型:实时生成文本、音频和图像

中国人工智能领域的知名企业云知声,于2024年8月23日在北京宣布推出其最新研发成果——山海多模态大模型。 通过整合跨模态信息,山海多模态大模型能够接收文本、音频、图像等多种形式作为输入,并实时生成文本、音频和图像的任意组合输出。 海多模态大模型有如下特点: 实时秒回,自由插话:与现实对话中人类的响应时间相似;支持对话随时打断,用户可在对话中任意插话 感知情绪,表达情绪:通过语音文本判断用户情绪,…- 5.4k

-

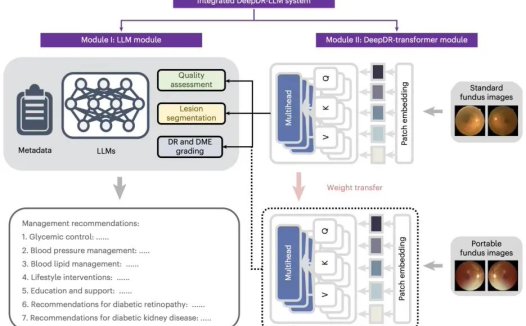

国际首个,我国团队开发糖尿病诊疗多模态大模型 DeepDR-LLM

从上海市第六人民医院官方公众号获悉,上海交通大学医学院附属第六人民医院贾伟平教授和李华婷教授团队与上海交通大学电院计算机系 / 教育部人工智能重点实验室盛斌教授团队,携手清华大学黄天荫教授团队与新加坡国立大学覃宇宗教授团队,通过医工交叉合作研究,构建了全球首个面向糖尿病诊疗的视觉-大语言模型的多模态集成智能系统 DeepDR-LLM,成果于 2024 年 7 月 19 日在 Nature Medi…- 1.8k

-

商汤绝影行业首发原生多模态大模型车端部署:80 亿参数、每秒 40 Tokens

商汤科技联合创始人、首席科学家王晓刚 17 日宣布,商汤绝影在行业内率先实现了原生多模态大模型的车端部署。车载端侧 8B 模型首包延迟在 300 毫秒以内,推理速度 40 Tokens / 秒,覆盖主流算力平台。 商汤绝影为多模态大模型打造计算引擎“HyperPPL”,目前扩展并支持主流车载计算硬件,兼容多种主流操作系统,适配多个车载芯片的部署平台。 商汤绝影称 HyperPPL 针对车载多人场景…- 2.1k

-

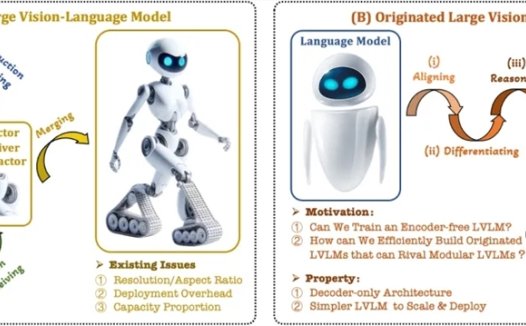

智源研究院推出新一代无编码器视觉语言多模态大模型EVE

近期,多模态大模型的研究和应用取得了显著进展。国外公司如OpenAI、Google、Microsoft等推出了一系列先进的模型,国内也有智谱AI、阶跃星辰等机构在该领域取得了突破。这些模型通常依赖视觉编码器来提取视觉特征并与大语言模型结合,但存在训练分离导致的视觉归纳偏置问题,限制了多模态大模型的部署效率和性能。 为解决这些问题,智源研究院联合大连理工大学、北京大学等高校推出了新一代无编码器的视觉…- 2.5k

-

一款免费AI聊天机器人,千亿多模态大模型跃问试用介绍

“跃问”是由阶跃星辰开发的一款基于Step-1和Step-1V千亿参数大模型的AI效率工具。早在一个月前,官方就已正式开放了。 Step-1在逻辑推理、中文知识、英文知识、数学、代码等方面的表现全面超越了GPT-3.5。 Step-1V则在中国权威的大型模型评估平台“司南”(OpenCompass)的多模态模型评测中位列第一(3月数据,目前位于第四),性能与GPT-4V相媲美。 它具备文本理解与生…- 9.7k

-

智谱开源新一代多模态大模型CogVLM2

智谱·AI最近宣布推出新一代多模态大模型CogVLM2,该模型在关键性能指标上相较于前一代CogVLM有了显著提升,同时支持8K文本长度和高达1344*1344分辨率的图像。CogVLM2在OCRbench基准上性能提升了32%,在TextVQA基准上性能提升了21.9%,显示出强大的文档图像理解能力。尽管CogVLM2的模型大小为19B,但其性能接近或超过了GPT-4V的水平。 CogVLM2的…- 4.9k

-

vivo 自研蓝心大模型升级“自研 AI 多模态大模型”

在正在举行的 vivo 影像新蓝图暨 X 系列新品发布会上,vivo 宣布自研蓝心大模型升级「自研 AI 多模态大模型」,多模态技术让大模型从最原始的视觉、声音、空间等方面接触、感知、理解世界,让大模型更全面、更聪明、更强大。 此外,vivo 看见 | 多模态大模型技术应用 ——「vivo 看见蓝心升级版」,帮助视障用户更好地“看见”世界。 去年 11 月 1 日,在 2023 vivo 开发者大…- 3.5k

-

阶跃星辰宣布推出 Step 系列通用大模型

阶跃星辰团队宣布推出了 Step 系列通用大模型,包括 Step-1千亿参数语言大模型、Step-1V 千亿参数多模态大模型,以及 Step-2万亿参数 MoE 语言大模型的预览版。 据悉,阶跃星辰成立于2023年4月,以 “智能阶跃,十倍每一个人的可能” 为使命。公司坚持自研超级模型,积极布局算力、数据等关键资源,发挥算法和人才优势。 目前已完成 Step-1千亿参数语言大模型和 …- 4.6k

-

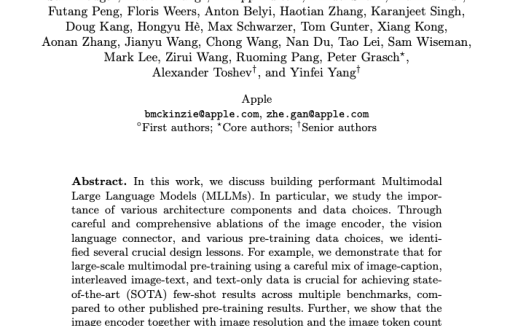

苹果推出 300 亿参数 MM1 多模态 AI大模型,可识别图像推理自然语言

苹果公司旗下研究团队近日在 ArXiv 中公布了一篇名为《MM1:Methods, Analysis & Insights from Multimodal LLM Pre-training》的论文,其中介绍了一款 “MM1”多模态大模型,该模型提供 30 亿、70 亿、300 亿三种参数规模,拥有图像识别和自然语言推理能力。 苹果研究团队相关论文主要是利用 MM1 模型做实验,通过控制各种…- 3.3k

-

香港大模型公司Weitu AI完成天使轮融资,估值一亿美金

近日,香港初创公司 Weitu AI 宣布成功完成天使轮融资,估值高达一亿美金。投资方包括全球数亿月活的互联网科技公司和著名天使投资人。 Weitu AI 公司刚刚成立,团队成员超过半数毕业于北美名校,拥有海外大厂工作经验。团队汇聚了长期活跃在人工智能多模态领域的研究专家,其中还包括去年初率队研发国内首批中文大语言模型的技术负责人。 公司表示,多模态大模型的研发需要同时具备基础大模型研发能力和长期…- 5.1k

-

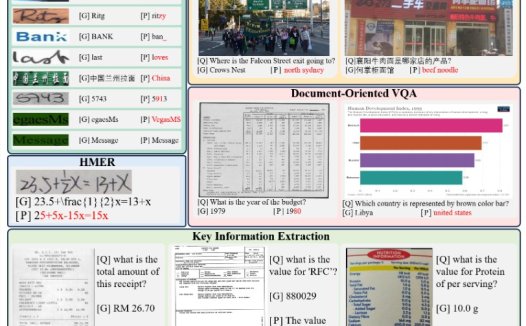

华科大发布多模态大模型新基准 覆盖五大任务

近期,华中科技大学等机构发布了一项关于多模态大模型(LMMs)的全面评估新基准,旨在解决多模态大模型性能评估的问题。这项研究涉及了14个主流多模态大模型,包括谷歌Gemini、OpenAI GPT-4V等,覆盖了五大任务、27个数据集。然而,由于多模态大模型的回答具有开放性,评估各个方面的性能成为一个亟待解决的问题。 在这项研究中,特别强调了多模态大模型在光学字符识别(OCR)方面的能力。研究团队…- 1.9k

-

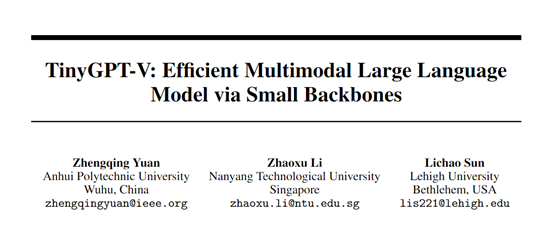

参数小,性能强!开源多模态模型—TinyGPT-V

安徽工程大学、南洋理工大学和理海大学的研究人员开源了多模态大模型——TinyGPT-V。 TinyGPT-V以微软开源的Phi-2作为基础大语言模型,同时使用了视觉模型EVA实现多模态能力。尽管TinyGPT-V只有28亿参数,但其性能可以媲美上百亿参数的模型。 此外,TinyGPT-V训练只需要24G GPU就能完成,不需要A100、H100那些高端显卡来训练。 所以,非常适用于中小型企业和个人…- 1.8k

-

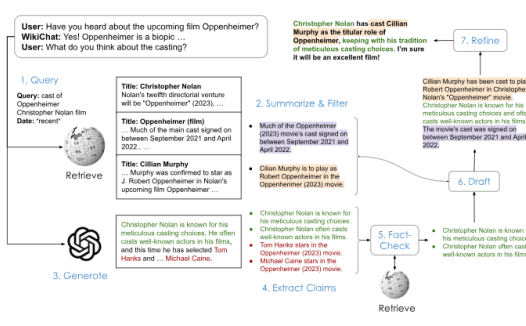

清华、浙大推GPT-4V开源平替!LLaVA、CogAgent等开源视觉模型大爆发

近期,GPT-4V的开源替代方案在中国的顶尖学府清华、浙大等的推动下,出现了一系列性能优异的开源视觉模型。其中,LLaVA、CogAgent和BakLLaVA是三种备受关注的开源视觉语言模型。 LLaVA是一个端到端训练的多模态大模型,它将视觉编码器和用于通用视觉和语言理解的Vicuna相结合,具备令人印象深刻的聊天能力。而CogAgent是在CogVLM基础上改进的开源视觉语言模型,拥有110亿…- 5.3k

-

华中科技大学开源多模态大模型Monkey

Monkey 是华中科技大学与金山软件联合推出的一种高性能多模态大模型,通过提高输入分辨率和引入多级描述生成方法,解决了现有模型在复杂场景和视觉细节处理方面的挑战。Monkey 可以基于现有视觉编辑器进行构建,无需从0预训练,大大提高了研发效率。 Monkey 的多级描述生成方法可以为模型提供丰富的上下文信息,指导模型学习场景和对象之间的关联。通过在16个不同的数据集上进行测试,Monkey 在图…- 3.1k

❯

搜索

扫码打开当前页

返回顶部

幸运之星即将降临……

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠

-

¥優惠使用時效:无法使用使用時效:

之前

使用時效:预期有效优惠编号:×

没有优惠可用!