-

阶跃星辰 Step-Video-TI2V 图生视频模型开源:运动幅度和镜头运动可控

3 月 20 日消息,今年 2 月阶跃星辰开源了两款 Step 系列多模态大模型 ——Step-Video-T2V 视频生成模型和 Step-Audio 语音模型,今天阶跃星辰继续开源图生视频模型 ——Step-Video-TI2V,一款基于 30B 参数 Step-Video-T2V 训练的图生视频模型,支持生成 102 帧、5 秒、540P 分辨率的视频,具备运动幅度可控和镜头运动可控两大核心…- 2.3k

-

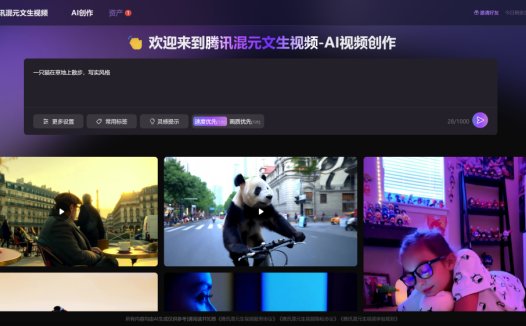

腾讯混元发布并开源图生视频模型:可生成 5 秒短视频,还能自动配上背景音效

3 月 6 日消息,1AI从腾讯混元微信公众号获悉,腾讯混元发布图生视频模型并对外开源,同时上线对口型与动作驱动等玩法,并支持生成背景音效及 2K 高质量视频。 基于图生视频的能力,用户只需上传一张图片,并简短描述希望画面如何运动、镜头如何调度等,混元即可按要求让图片动起来,变成 5 秒的短视频,还能自动配上背景音效。此外,上传一张人物图片,并输入希望“对口型”的文字或音频,图片中的人物即可“说话…- 2.5k

-

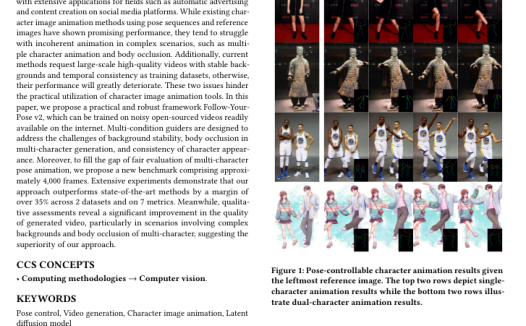

腾讯联合中山大学、港科大推出图生视频模型“Follow-Your-Pose-v2”

腾讯混元团队联合中山大学、香港科技大学联合推出全新图生视频模型“Follow-Your-Pose-v2”,相关成果已经发表在 arxiv 上(附 DOI:10.48550/arXiv.2406.03035)。 据介绍,“Follow-Your-Pose-v2”只需要输入一张人物图片和一段动作视频,就可以让图片上的人跟随视频上的动作动起来,生成视频长度可达 10 秒。 与此前推出的模型相比,“Fol…- 3.8k

-

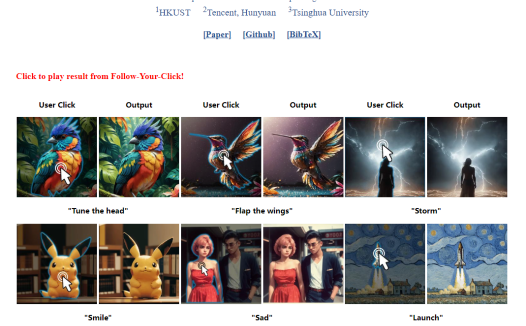

腾讯联合清华大学、香港科技大学推出全新图生视频模型“Follow-Your-Click”:用户指哪动哪

腾讯和清华大学、香港科技大学联合推出全新图生视频模型 “Follow-Your-Click”,目前已经上架 GitHub(代码四月公开),同时还发表了一篇研究论文(附 DOI:2403.08268)。 这款图生视频模型主要功能包括局部动画生成和多对象动画,支持多种动作表达,如头部调整、翅膀拍动等。 据介绍, Follow-Your-Click 可以通过用户的点击和简短动作提示生成局部图像动画。用户…- 2.9k