腾讯旗下的天琴实验室刚刚开源了AI数字人MuseV项目,项目全称是:基于视觉条件并行去噪的无限长度和高保真虚拟人视频生成(MuseV: Infinite-length and High Fidelity Virtual Human Video Generation with Visual Conditioned Parallel Denoising)。MuseV和其稍后发布的MuseTalk视频唇形同步是一套完整的AI数字人解决方案。随着这两个项目的开源我们可以免费制作不限时长的AI数字人了。

项目特点

1.不限时长

2.文本到视频生成

3.视频到视频生成

4.兼容 Stable Diffusion文生图生态系统,包括基础模型、Lora、Controlnet等

5.支持多参考图像技术,例如IPAdapter、ReferenceOnly、IPAdapterFaceID等

使用方法

目前MuseV开源项目有四种使用方法。

1.根据技术说明,自行克隆部署。

项目地址:github.com/tmelyralab/musev

2.官方在抱抱脸上开启了了Demo试用。

Demo地址:huggingface.co/spaces/AnchorFake/MuseVDemo

3.Windows本地部署一键运行。这个是B站大神“十字鱼”做的一键运行整合包,直接下载解压就可以一键运行。

网盘地址:https://www.123pan.com/s/Pf5Yjv-Bb9W3.html

提取码: glut

网盘里有两个文件,另一个是MuseTalk,下载后解压MuseV这个文件,然后点“01运行程序”这个文件。

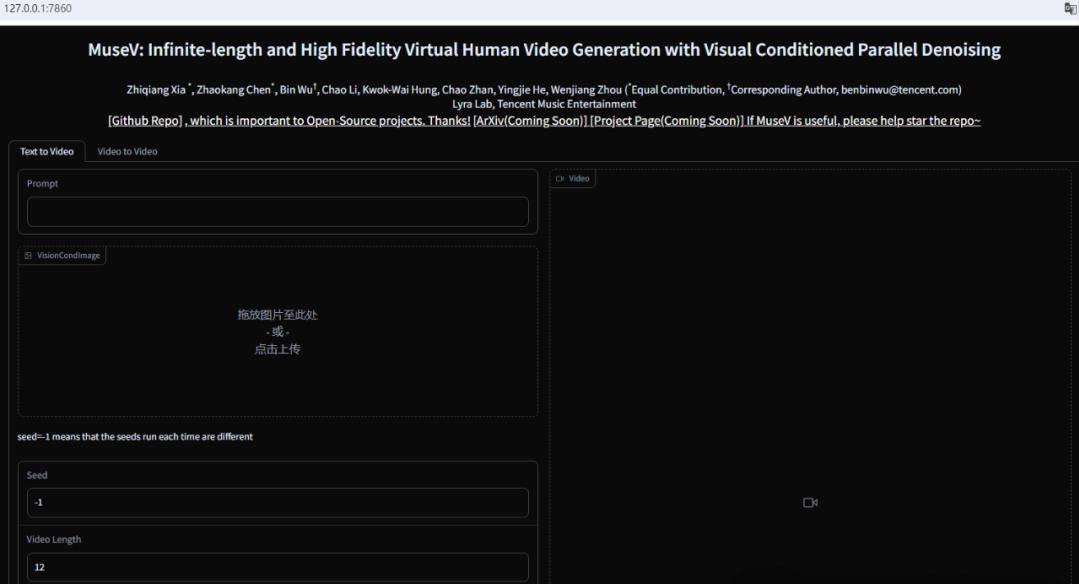

除了Video Length视频时长外,其他参数都可以不变,默认每秒6帧,时长12就代表生成2秒视频。

默认 W&H 为 -1,使用参考图像的尺寸。目标视频的大小为( W ,H )。图像尺寸越短,运动幅度越大,视频质量越低。W&H越长,运动幅度越小,视频质量越高。

注意事项:最好放在C盘全字母的文件夹;运行前开启魔法网络,因为还要自动下载几个模型;12G显存以上显卡,越大越好。

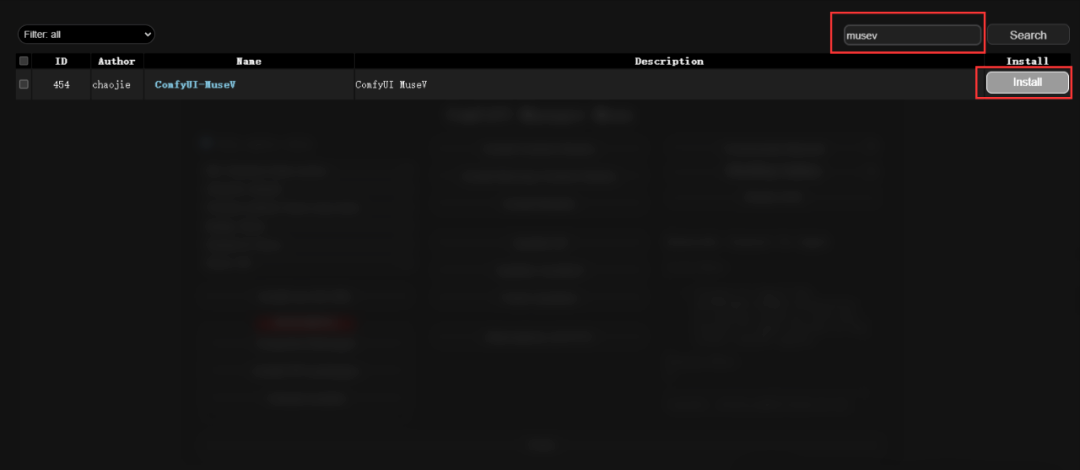

4.SD Comfyui运行。

在管理器中安装节点页面搜索“MuseV”,然后点安装

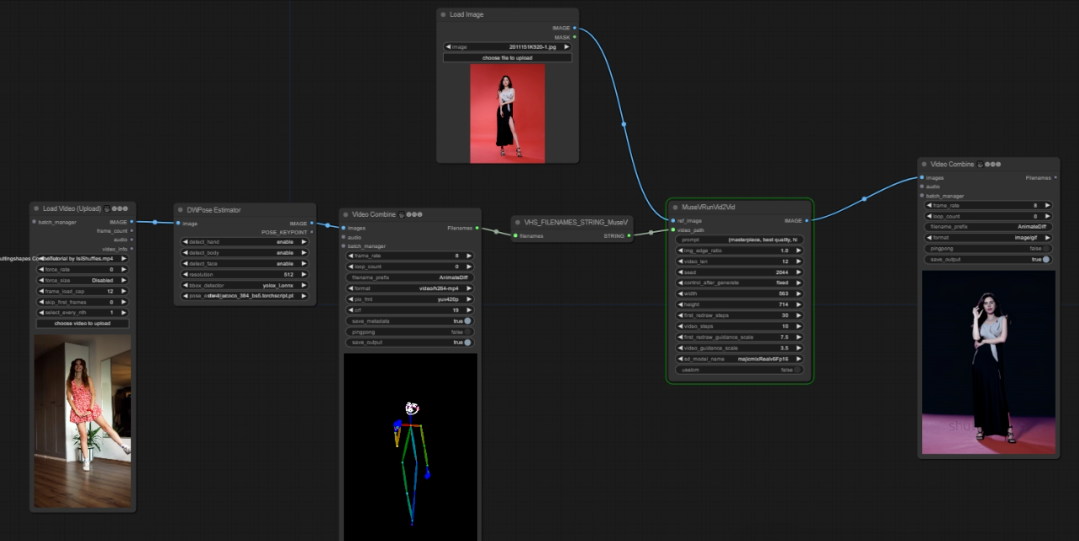

下载工作流导入Comfyui。

工作流下载地址:github.com/chaojie/ComfyUI-MuseV

整体来说效果不错,目前可控制的部分很少,图像越大,动作幅度越小,推荐不要超过1024。图像越大越吃显存,耗时也比较长,我生成一个1024*1536的10秒视频花了1个多小时,用的2080Ti 22G显存。下次再讲另一个MuseTalk唇形对准项目,这个更好玩。