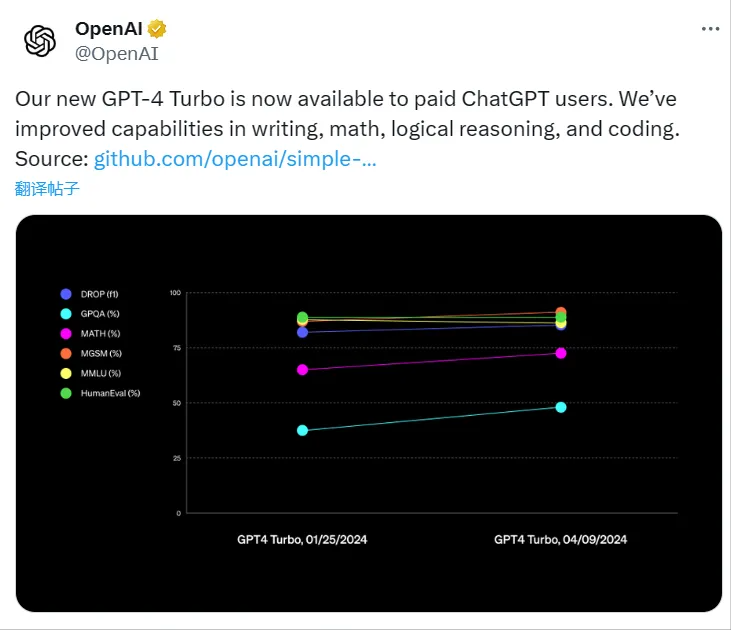

最近,OpenAI 推出了 GPT-4 Turbo 模型的新版本,它集成了视觉分析功能。

新版GPT-4 Turbo不仅能理解文本,还能解析图像。这项新增功能旨在通过支持更复杂和多样化的交互,来丰富用户的体验。目前,GPT-4 Turbo新版本正式向ChatGPT Plus会员开放。

此前,GPT-4 Turbo 仅适用于开发人员或拥有Microsoft Copilot 的用户。

微软Copilot 3月向免费用户开放了GPT-4 Turbo模型,详情去请看:如何在微软Copilot免费版中使用OpenAI的GPT-4 Turbo模型?

什么是GPT-4 Turbo with Vision?

GPT-4 Turbo with Vision 是 OpenAI 现有 GPT-4 模型的一个升级版,新增了在对话中直接处理图像的功能。

这意味着用户现在可以上传图像,AI 会根据图像内容生成答案,从而把交互从纯文本扩展到视觉内容。

该模型支持多种图像格式,包括 PNG、JPEG、WEBP 和非动画 GIF,每个文件的大小限制为 20MB。

可以进行更深入的对话

GPT-4 Turbo 支持 128k 的上下文,相当于一本 300 页的书的内容量,比之前的版本 GPT-3.5 Turbo 增加了8倍,大大提升其处理信息的能力。

用 Al 的术语来说,Token是指模型处理的数据单元。增加Token数量可以进行更广泛、更详细的对话。

此次更新确保了 AI 能够更轻松地处理长对话和更复杂的问题。

新版本的局限性

虽然GPT-4 Turbo with Vision是人工智能功能的一次飞跃,但它也有其局限性。

根据 OpenAI 的说法,它无法正确处理医学图像(例如CT扫描)、带有非英语或小文本的图像、以及特别花哨的文字或全景照片等。此外,这个系统不能用来处理验证码。

用户可以上传的文件格式包括PNG (.png)、JPEG (.jpeg和.jpg)、WEBP(.webp)和非动画GIF(.gif)文件格式,大小限制为20MB/图像。

实际应用和用户访问

除了解析图像之外,GPT-4 Turbo 还提供其他实用应用程序,包括网站创建、编码辅助等。这些工具旨在帮助专业人士和业余爱好者内容创作、解决编程问题和激发创意。

订阅ChatGPT Plus 即可使用这些高级功能,价格约为20美元/月。订阅用户不仅能解锁新的图像处理功能,还能让用户充分利用 AI 升级后在对话技能上的全部潜力。

详细ChatGPT Plus订阅教程请看:国内如何开通ChatGPT Plus会员?

为什么此更新很重要

因为 OpenAI 将视觉处理功能整合到了 ChatGPT 中,为用户与 AI 的互动开辟了新的途径。

你可以让 AI 在提供答案时,同时考虑文本和视觉信息,从而给出更全面、更符合上下文的响应。

无论是帮助理解图像中的复杂数据,还是通过讨论视觉内容使数字对话更加生动,这次更新让与 AI 的互动更加深入,更像是在跟真人一样交流。

好啦,今天就到这里,如果你觉得这篇文章对你有用,别忘了推荐给你的同事和朋友哦!