360 公司日前在 GitHub 上开源了 360 智脑 7B(70 亿参数模型)。360 智脑大模型采用 3.4 万亿 Tokens 的语料库训练,以中文、英文、代码为主,开放 4K、32K、360K 三种不同文本长度。360 表示,360K(约 50 万字)是当前国产开源模型文本长度最长的。

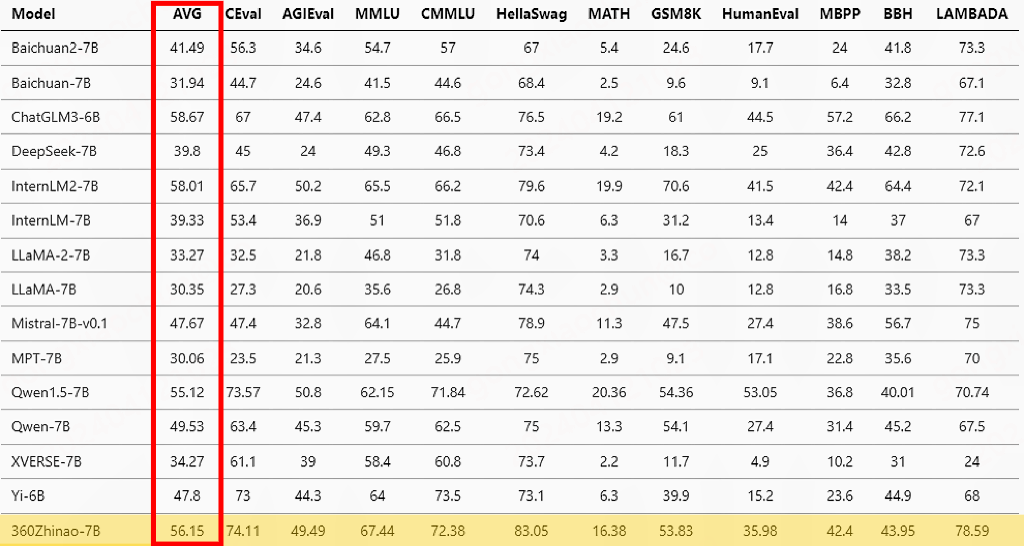

360 表示,他们在 OpenCompass 的主流评测数据集上验证了模型性能,包括 C-Eval、AGIEval、MMLU、CMMLU、HellaSwag、MATH、GSM8K、HumanEval、MBPP、BBH、LAMBADA,考察的能力包括自然语言理解、知识、数学计算和推理、代码生成、逻辑推理等。其中 360 模型在四个评测数据集上达到第一,平均分为第三。

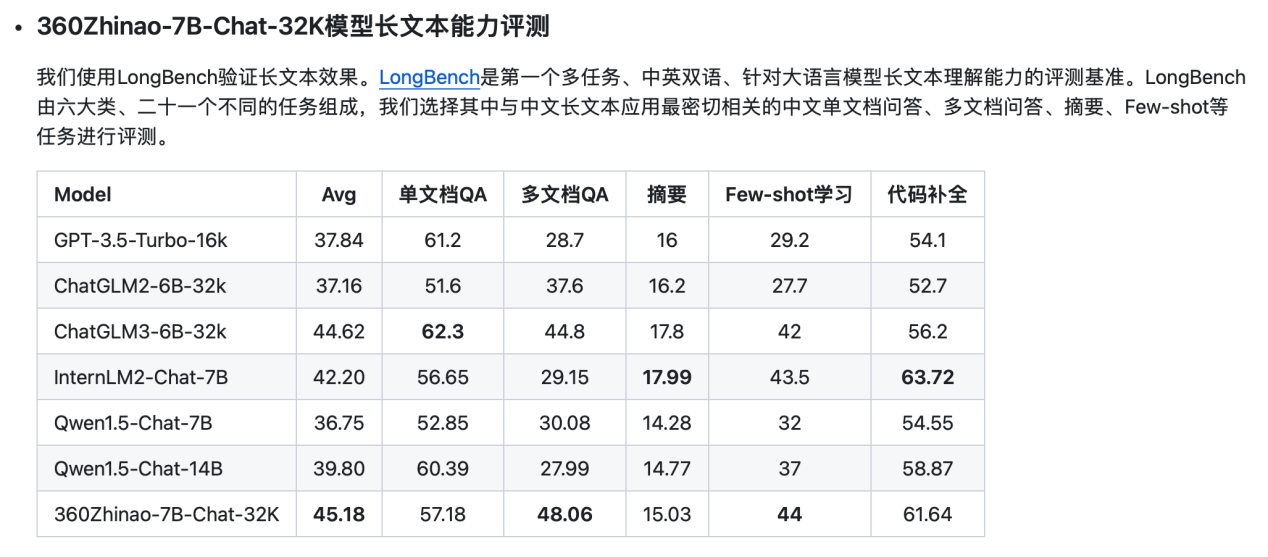

在 LongBench(多任务、中英双语、针对大语言模型长文本理解能力的评测基准)测试中,360 选择其中与中文长文本应用最密切相关的中文单文档问答、多文档问答、摘要、Few-shot 等任务进行评测,360Zhinao-7B-Chat-32K 模型取得了平均分第一的成绩。

在英文大海捞针测试(NeedleInAHaystack,是将关键信息插入一段长文本的不同位置,再对该关键信息提问,从而测试大模型的长文本能力的一种方法)中,360Zhinao-7B-Chat-360K 达到 98% 以上的准确率。360 仿照 SuperCLUE-200K 测评基准构造了中文大海捞针测试,同样做到了 98% 以上的准确率。

除模型权重外,该模型的微调训练代码,推理代码等全套工具集也被一并开源,大模型相关开发者可做到“开箱即用”。

周鸿祎曾表示,前段时间大模型行业卷文本长度,100 万字“很快将是标配”。“我们打算将这个能力开源,大家没必要重复造轮子,定为 360K 主要是为了讨个口彩。”他还自称“开源的信徒”,信奉开源的力量。