谷歌近日在 GitHub 页面发布博文,介绍了 VLOGGER AI模型,用户只需要输入一张肖像照片和一段音频内容,该模型可以让这些人物“动起来”,富有面部表情地朗读音频内容。

VLOGGER AI 是一种适用于虚拟肖像的多模态 Diffusion 模型,使用 MENTOR 数据库进行训练,该数据库中包含超过 80 万名人物肖像,以及累计超过 2200 小时的影片,从而让 VLOGGER 生成不同种族、不同年龄、不同穿着、不同姿势的肖像影片。

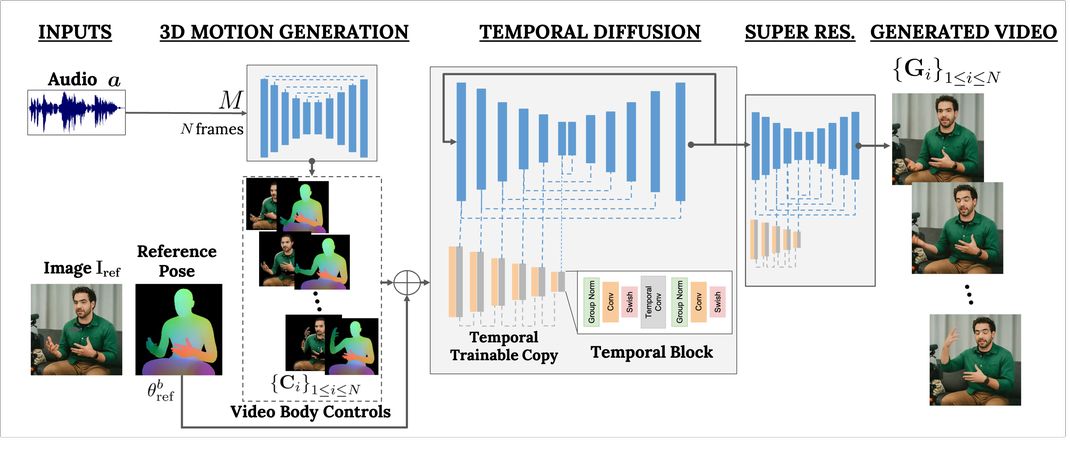

研究人员表示:“和此前的多模态相比,VLOGGER 的优势在于不需要对每个人进行训练,不依赖于人脸检测和裁剪,可以生成完整的图像(而不仅仅是人脸或嘴唇),并且考虑了广泛的场景(例如可见躯干或不同的主体身份),这些对于正确合成交流的人类至关重要”。

Google 将 VLOGGER 视为迈向“通用聊天机器人”的一步,之后 AI 就可以通过语音、手势和眼神交流以自然的方式与人类互动。

VLOGGER 的应用场景还包括可以用于报告、教育场域和旁白等,也可剪辑既有的影片,如果对影片中的表情不满意就能加以调整。

附上论文参考