图像修复一直是一个备受研究者关注的复杂挑战,其主要目标是在维持降质输入的感知质量的同时,创建视觉上吸引人且自然的图像。在没有有关主题或降质的信息的情况下(盲目恢复),了解自然图像范围至关重要。为了恢复面部图像,必须在确保输出保留个体独特面部特征之前包含身份信息。以往的研究已经探讨了使用基于参考的面部图像恢复的方法来解决这一要求。然而,将个性化整合到基于扩散的盲目恢复系统仍然是一个持久性的挑战。

加利福尼亚大学洛杉矶分校和Snap Inc.的研究团队开发了一种名为“Dual-Pivot Tuning”的个性化图像恢复方法。双轴调整是一种用于在盲目图像恢复背景下定制文本到图像的先验的方法。该过程涉及使用个体的一组有限数量的高质量图像来增强其其他降质图像的恢复。其主要目标是确保恢复的图像对个体的身份和降质输入图像具有高保真度,同时保持自然外观。

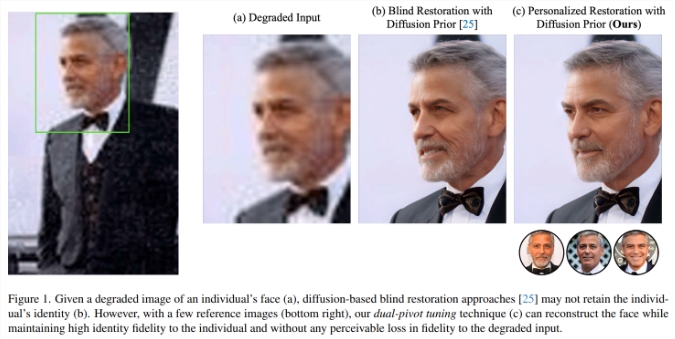

研究讨论了基于扩散的盲目恢复方法,当应用于降级的面部图像时,可能无法有效保留个体的独特身份。研究人员强调了以前在基于参考的面部图像恢复方面的努力,引用了各种方法,如GFRNet、GWAINet、ASFFNet、Wang等,DMDNet和MyStyle。这些方法利用单个或多个参考图像来实现个性化恢复,确保对降级图像中个体独特特征的更好保真度。与以往方法不同,提出的技术使用基于扩散的个性化生成先验,而其他方法使用前馈架构或基于GAN的先验。

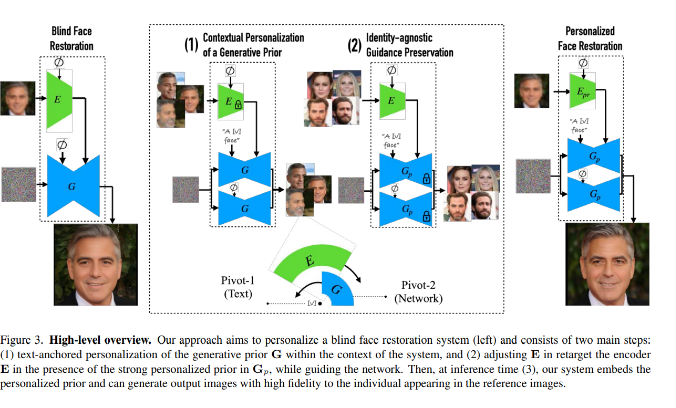

研究概述了为图像恢复个性化引导扩散模型的方法。Dual-Pivot Tuning技术包括两个步骤:基于文本的微调,将身份特定信息嵌入扩散先验中,以及模型中心的枢轴,将引导图像编码器与个性化先验协调一致。文本到图像扩散模型的个性化运算符被定义为通过枢轴微调模型以创建定制版本。该技术包括上下文文本枢轴,注入身份信息,然后是基于模型的枢轴,利用通用恢复在实现高保真度恢复的图像之前。

提出的Dual-Pivot Tuning技术通过个性化恢复在恢复图像中实现了高身份保真度和自然外观。定性比较表明,基于扩散的盲目恢复方法可能无法保留个体的身份,而提出的技术在保持高身份保真度的同时,没有可感知的对降质输入的保真度损失。使用PSNR、SSIM和ArcFace相似性等指标的定量评估表明,所提方法在恢复图像方面对个体身份的高保真度非常有效。

通过Dual-Pivot Tuning实现的个性化恢复技术在恢复图像中实现了高身份保真度和自然外观。实验证明,与盲目和少数样本的面部图像恢复的各种最先进替代方法相比,定制模型在个体身份方面表现更好,并且在一般图像质量方面优于通用先验。该方法对不同类型的降解是不可知的,并在保持身份的同时提供一致的恢复。