MuseTalk 是由腾讯音乐天琴实验室开发的一款实时高质量音频驱动的口型同步模型,专门用于虚拟人口型生成。该模型能够根据输入的音频信号自动调整数字人物的面部图像,使其唇形与音频内容高度同步,从而达到口型与声音匹配的效果。MuseTalk 在口型生成方面表现出色,能够生成准确且画面一致性良好的口型,尤其擅长真人视频生成。

MuseTalk 的主要功能特点包括:

- 实时性能:在 NVIDIA Tesla V100 上可以实现每秒30帧以上的实时推理。

- 多语言支持:支持中文、英文和日文等多种语言的音频输入,这使得它能够为不同国家和地区的用户提供服务。

- 高精度口型同步:通过潜在空间修复(Latent Space Inpainting)技术,能够在256 x 256像素的面部区域上进行高精度的口型修改。

- 高画面一致性:生成的口型与声音匹配效果准确且画面一致性良好。

- 广泛的应用场景:适用于多种视频内容处理需求,如自媒体制作、虚拟主播等。

不过,MuseTalk的部署过程比较麻烦,对于小白用户来说很有难度,而且对电脑显卡和内存等都有较高要求。幸好有大好人谷歌推出的google colab,借助它我们可以快速免费而且非常简单的部署MuseTalk。Google Colab(也称为Colaboratory)是一个由Google提供的免费云端开发环境,主要用于数据分析、机器学习和深度学习等任务。它基于Jupyter Notebook,用户可以通过浏览器直接编写和执行Python代码,并且可以与他人共享和协作编辑代码。

首先,打开这个地址:

https://colab.research.google.com/github/camenduru/MuseTalk-jupyter/blob/main/MuseTalk_jupyter.ipynb

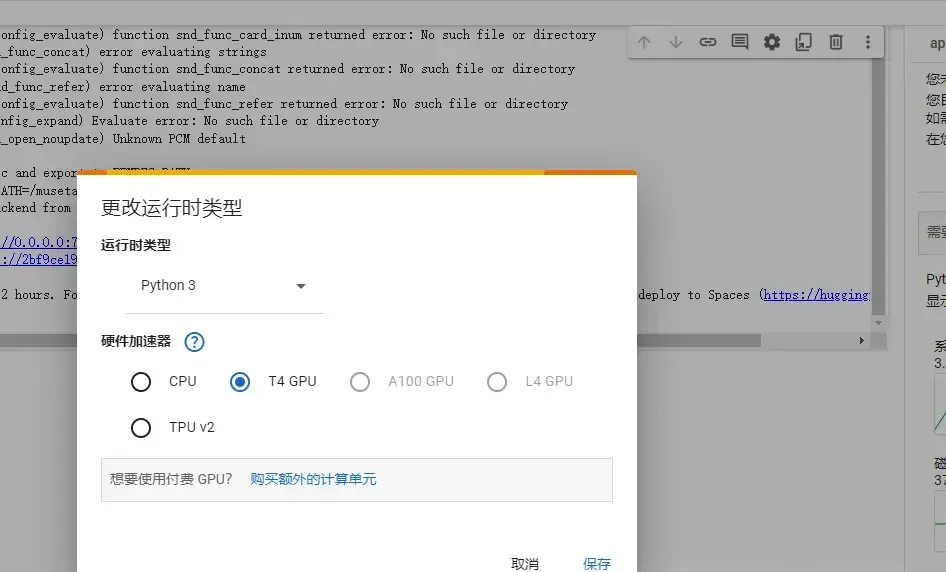

点击右上角,更改运行时类型,选择T4GPU

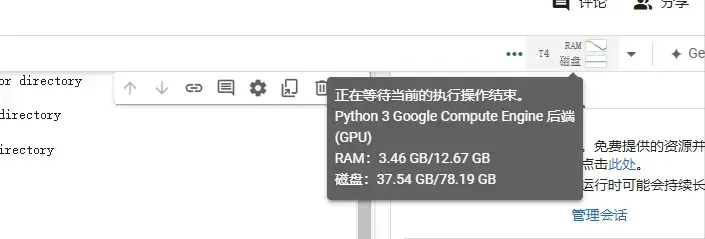

可以看到google colab给我们分配了免费的12G内存,78G硬盘,还有GPU算力资源;

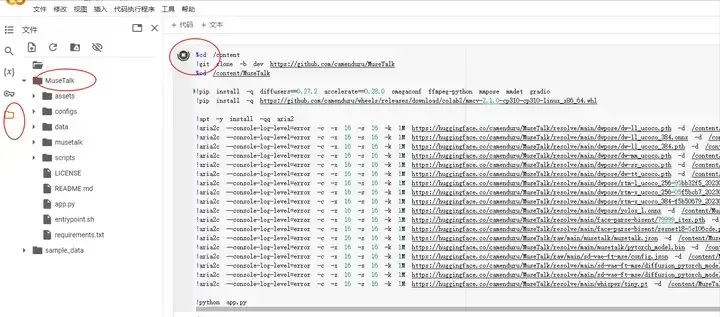

点击小三角,运行代码:

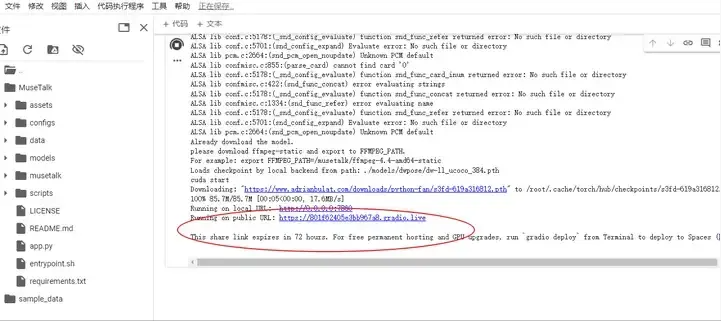

3分钟左右,运行成功,

看到Running on public URL这一行字,就代表MuseTalk已经成功部署了,然后点击这个网址:

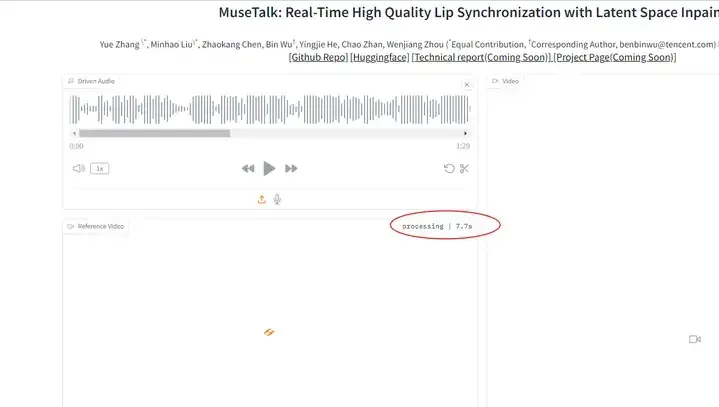

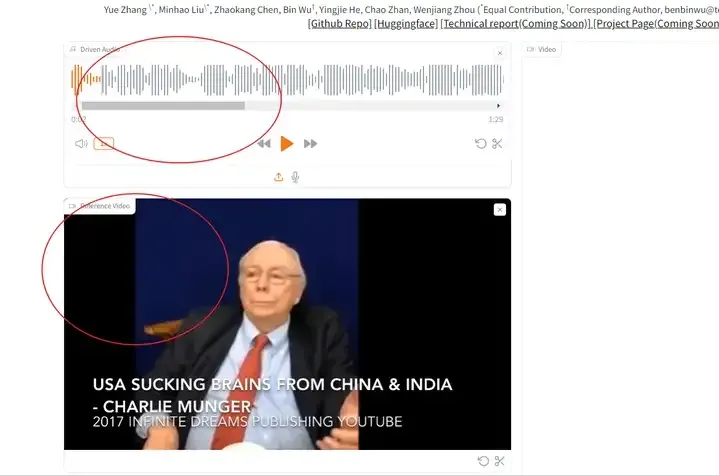

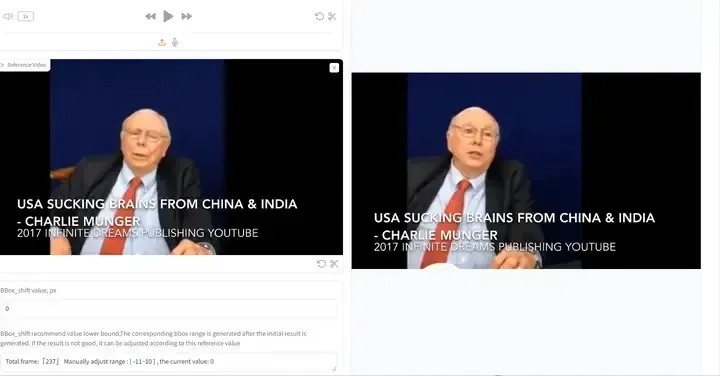

上传一个音频和一个参考视频:

视频上传后需要处理10多秒

然后点击:Generate

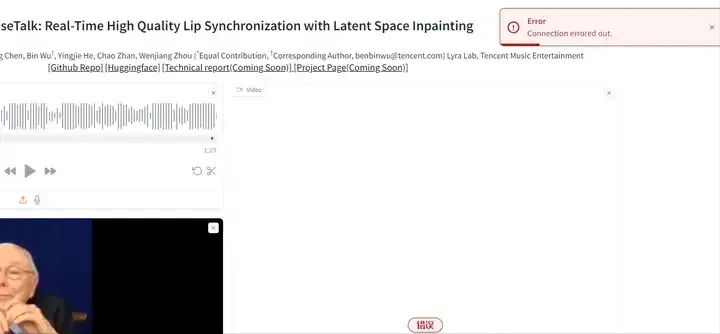

如果出现:Error,Connection errored out.

可以把视频时长、音频时长裁剪短一些,20秒左右;然后再次运行;

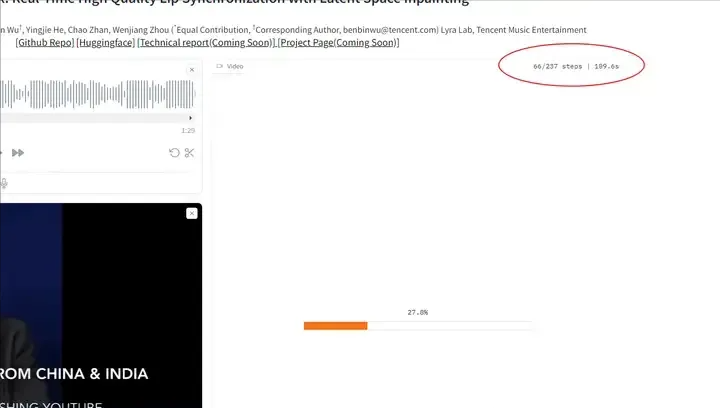

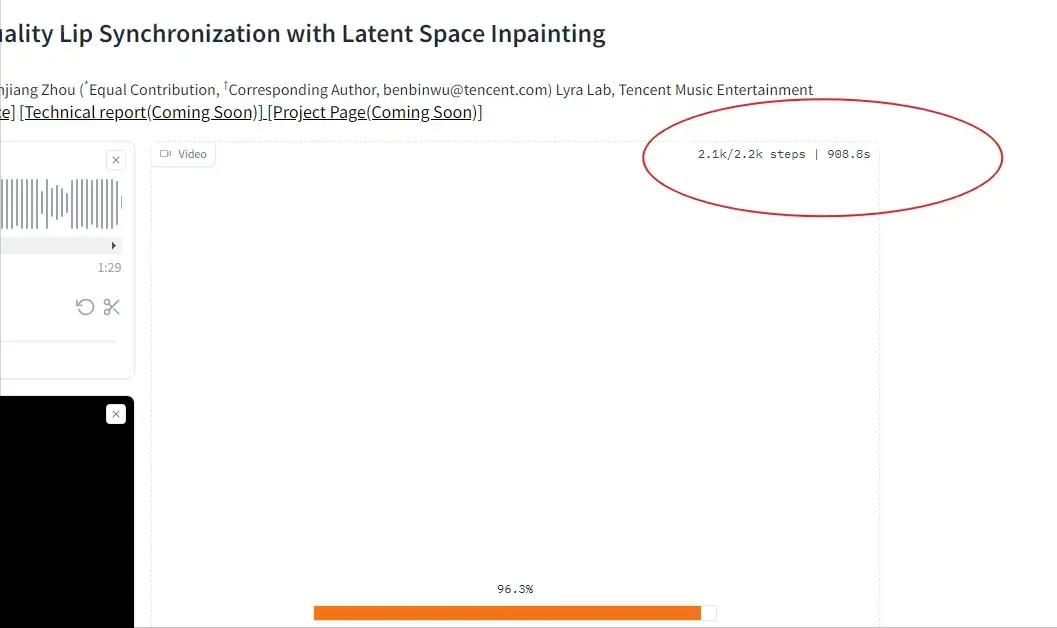

最后一步需要时间较多,通常是20多分钟;

右边出现视频,就说明处理完成了:

然后点击右上角的download,可以下载处理好的视频。