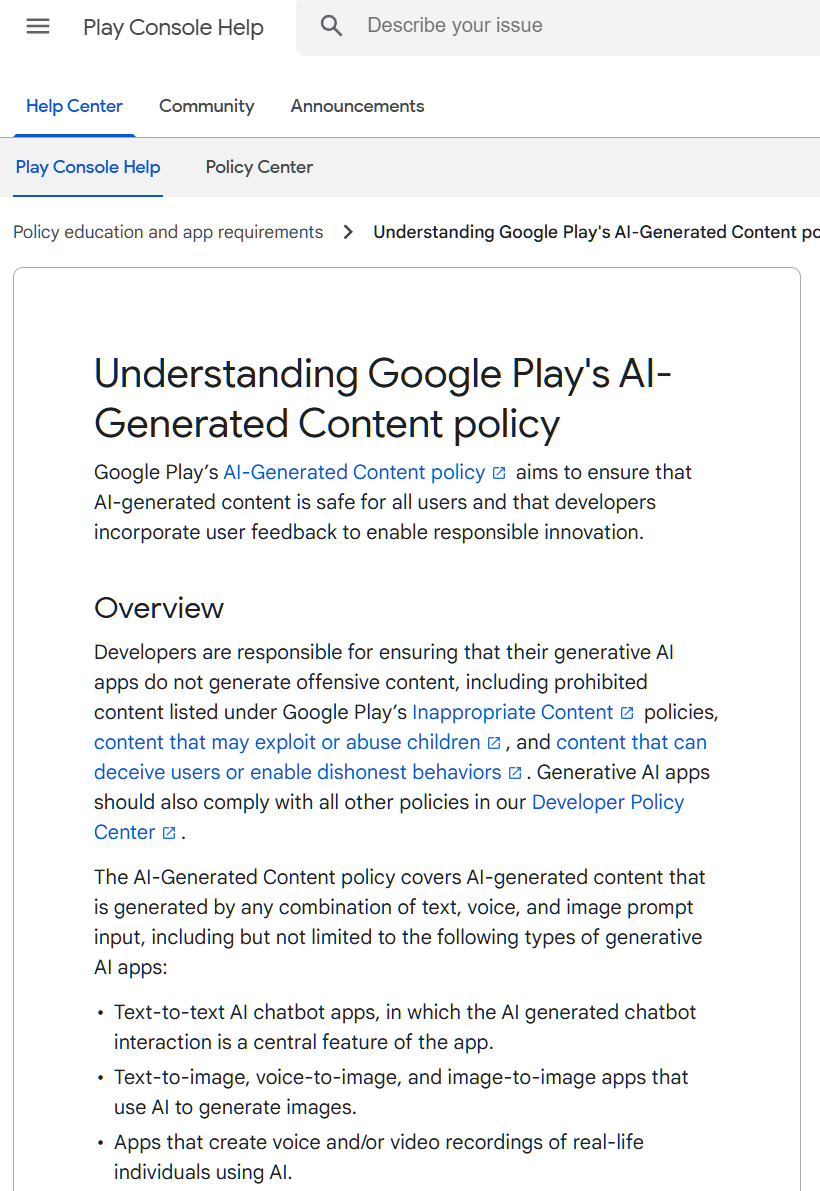

谷歌针对 AI 类应用程序更新了指导方针,目标是减少“不适当的”和“被禁止的”内容。

谷歌在新的政策中指出,提供生成式 AI 功能的应用必须防止生成受限制的内容,包括色情内容、暴力等,并要求应用对其 AI 模型进行“严格测试”。

这些规则适用于多种应用程序,简要汇总如下:

-

以文本、语音和图像提示输入的任何组合,经由生成式 AI 产生内容的 App。

-

聊天机器人类、图像生成类(文生图、音生图、图生图)、语音及视频生成类 App。

-

不适用于“仅仅承载”AI 内容的 App,或将 AI 用作生产力工具的 App。

谷歌Play 明确,AI 生成的违规内容包括不限于如下案例:

-

人工智能生成的未经同意的深度伪造性材料。

-

为诈骗提供便利的真人语音或视频记录。

-

鼓励有害行为(如危险活动、自我伤害)的内容。

-

为助长欺凌和骚扰行为而生成的内容。

-

主要是为了满足“性需求”的内容。

-

使不诚实行为成为可能的 AI 生成“官方”文件。

-

创建恶意代码。

谷歌未来还将增加新的应用上架功能,力图使向商店提交生成式 AI 应用的过程变得更为公开透明、简单化。