Stable Diffusion是什么?

Stable Diffusion是一种深度学习模型,专门用于图像生成。它属于生成对抗网络(GAN)的一种,但与传统的GAN有所不同。Stable Diffusion的核心特点是它的稳定性和高效性,这使得它在生成高质量图像方面特别有效。

这种模型通常由两部分组成:一个生成器和一个鉴别器。生成器的任务是创建图像,而鉴别器的任务是区分生成的图像和真实图像。通过这种方式,生成器在生成越来越逼真的图像方面变得越来越好。

Stable Diffusion的一个关键创新是它在处理图像时的稳定性。在传统的GAN中,生成器和鉴别器之间的动态往往导致训练过程不稳定,这可能会导致生成的图像质量不高或者训练过程难以收敛。Stable Diffusion通过改进这些动态来解决这些问题,从而能够更可靠地生成高质量的图像。

此外,Stable Diffusion还采用了一些先进的技术来提高效率和图像质量,例如改进的网络架构和训练策略。这使得它在生成复杂和高分辨率图像方面特别有效,同时保持较低的计算成本。

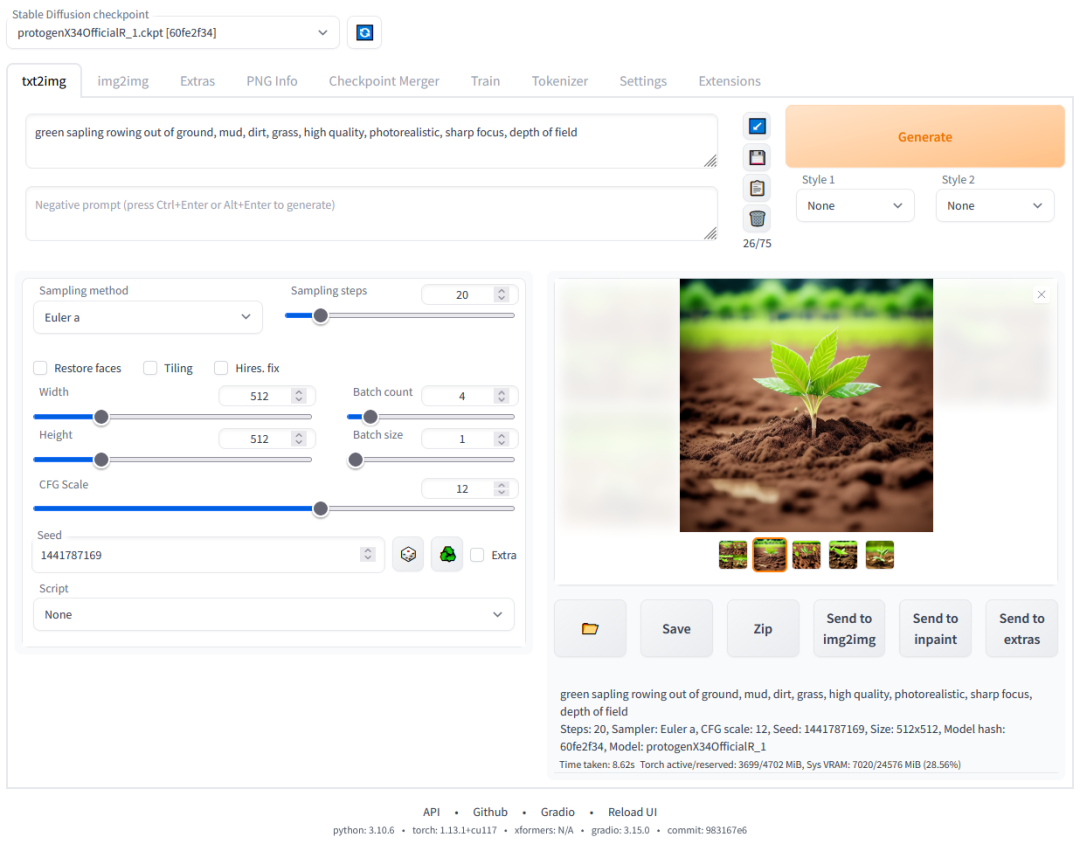

SDWebUI是什么?

SDWebUI(Stable Diffusion Web UI)是一个为Stable Diffusion模型设计的浏览器界面。Stable Diffusion是一个用于图像生成的深度学习模型。SDWebUI基于Gradio库构建,为用户提供了一个友好的界面,以便与Stable Diffusion模型交互。它简化了从文本描述生成图像(txt2img)和修改现有图像(img2img)的过程。

SDWebUI的主要特点

- 易用性:SDWebUI提供了一键安装和运行脚本,尽管还需要单独安装Python和Git。这大大降低了对编程或机器学习环境不熟悉的用户的使用门槛。

- 高级图像处理工具:界面包括扩展图像边界(outpainting)、编辑图像部分(inpainting)和彩色素描等选项。还提供了“提示矩阵”(Prompt Matrix),用于尝试不同的文本提示,以及提高图像分辨率的放大功能。

- 注意力机制:用户可以指定模型应更多关注的文本部分,增强生成图像与输入提示的相关性。

- 循环反馈和绘图功能:循环反馈功能允许多次进行img2img处理,X/Y/Z绘图功能提供了一种以3D图形格式可视化具有不同参数的图像的方法。

- 文本反演和嵌入:SDWebUI支持文本反演,允许用户拥有多个可自定义名称的嵌入,并具有不同数量的向量。它还支持半精度浮点数,并支持在最低6GB内存的GPU上训练嵌入。

- 附加工具和扩展:额外标签页包括GFPGAN面部修复工具、多种神经网络放大器(如RealESRGAN和SwinIR)和调整图像纵横比的选项。用户还可以选择不同的采样方法并调整噪声设置。

- 兼容性和支持:SDWebUI支持多种硬件配置,包括NVidia、AMD GPU和Intel CPU/GPU。它还提供了多种安装选项,包括适用于Windows、Linux和Apple Silicon的选项。

- 自定义和扩展:界面允许高度自定义,包括更改UI元素的默认值、添加样式和生成图像变体。它还支持集成社区的自定义脚本和扩展。

- API和高级功能:SDWebUI包括一个用于高级用户的API、支持专用的图像修复模型,以及CLIP审问器(用于从图像猜测提示)、批量处理和检查点合并等功能。

市面上最常见的webui封装可以直接下载秋叶的安装包,不需要配置环境等复杂的操作,开箱即用

https://www.bilibili.com/video/BV1iM4y1y7oA