随着科技的飞速发展,人工智能(AI)已经不再是遥不可及的未来科技,而是逐步融入我们生活的各个角落。从智能家居的便捷操控,到线上服务的智能推荐,再到医疗、教育等行业的深度应用,AI正以其独特的魅力改变着世界。然而,对于许多普通人而言,AI似乎仍然是一个充满神秘感的高科技领域。那么作为普通人,我们该如何尝鲜AI技术呢?

以网页版AI为代表的“云端AI”

当我们提到AI时,相信很多人的脑海中都会浮现出一个名字——ChatGPT。没错,就是那个在科技圈掀起轩然大波的聊天机器人。它的发布,仿佛一道璀璨的闪电,照亮了AI领域的夜空,让我们真切地感受到了人工智能的无限可能。

ChatGPT是一款集成了尖端自然语言处理技术与深度学习能力的聊天机器人,它宛如一位博学多才的全能顾问,无论在哪个领域,都能针对您的问题提供详尽的解答。对于内容创作者而言,ChatGPT更是一位不可或缺的助手,它能生成高质量的图片、编写精准的代码、构思富有创意的文案、制作专业的PPT,并对文档进行润色,使文章内容更加出色。当然这些仅仅是ChatGPT功能的冰山一角,各位可以去亲自体验一番,了解它真正的实力。

从使用角度来说,ChatGPT使用起来非常简单。我们只需要打开网页,登陆账号就可以享受到相关的AI功能。

值得一提的是,在今年4月,OpenAI宣布ChatGPT(3.5版本)免费了。也就是说如果你只是想体验ChatGPT 3.5版本的话,连账号也不需要,只要登陆ChatGPT的网页就可以了。

如果你目前无法使用ChatGPT的话,国内也有很多厂商推出了类似ChatGPT的产品,比如百度的文心一言。根据百度官方的介绍,文心大模型4.0综合能力和 GPT-4相比毫不逊色。文心一言的使用方式和ChatGPT类似,也是只需要打开网页,登陆百度账号就可以享受到相关的AI功能。目前文心大模型3.5免费开放,文心大模型4.0则需要购买会员才可以使用。国内除了文心一言,还有其他一系列AI应用,如通义千问、豆包、智谱清言、腾讯混元以及讯飞星火等,这些AI应用在使用方法上是大同小异的。

当然以上这些其实都属于“云端AI”的范畴。“云端AI”简单来说就是将AI相关的数据处理放在服务器上跑,用户只需要通过网页、应用程序输入指令即可。这种部署模式有三个好处:

1、便宜:目前云端算力成本并不算太高,因此很多“云端AI”是免费开放的,就算是收费的会员,价格也不算太贵。以文心一言会员VIP为例,目前一个月也只要49.9元(连续包月,可随时取消)。

2、不挑设备:AI既然是放在服务器上跑,那么对于用户使用的终端基本就没什么性能要求了。毕竟找个能正常访问网页的电脑还是很容易的。

3、易用:由于“云端AI”的部署、维护、升级等工作是由厂商负责,所以对于用户来说基本是“即开即用”,往往只需要点开个网页登陆账号就能直接使用AI功能。

基于现有硬件本地部署AI

虽然“云端AI”有诸多优势,但还是有一个问题不能忽视,那就是数据私密性。此前三星就被曝出因ChatGPT而泄露芯片机密。当时因为三星员工直接将企业机密信息以提问的方式输入到ChatGPT中,导致相关内容进入学习数据库,从而造成信息泄露。对于这种情况,本地部署大模型其实是个很好的解决办法。

由于本地部署大模型是将AI放到本地设备上跑,相关的信息并不会发送到其它服务器上。所以当我们用这种方式处理个人隐私信息或者企业机密信息时就无需担忧信息外泄的风险。

不过从另一个方面看,本地设备的算力性能往往不如服务器,因此只有部分性能强的设备才适合本地部署大模型。

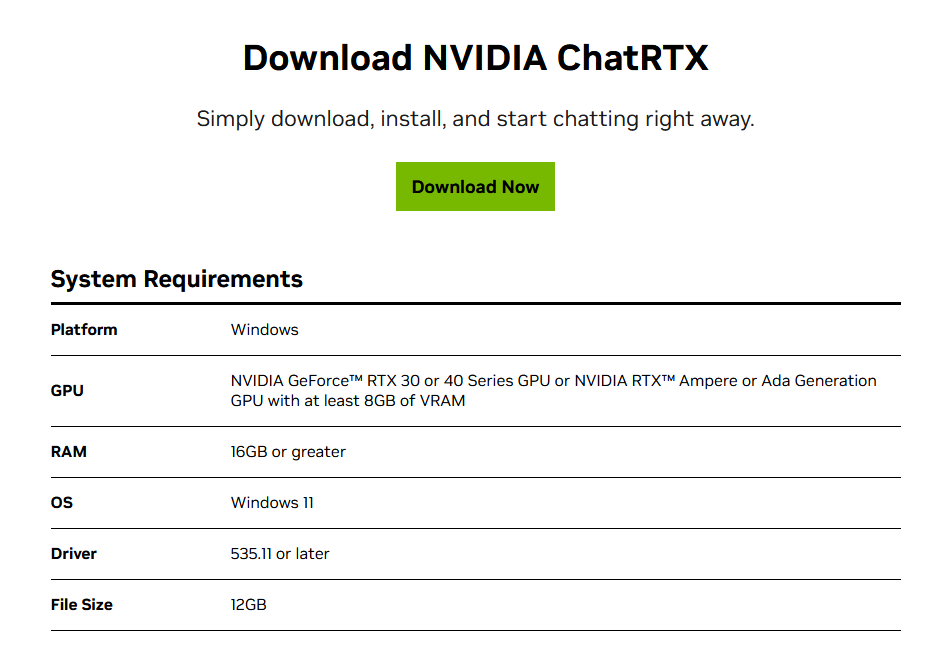

以英伟达发布的Chat With RTX为例,Chat With RTX 是一款基于语言大模型的应用程序,可让用户便捷连接到自己的内容(文档、笔记、视频或其他数据),利用RAG(检索增强生成)、TensorRT-LLM 和 RTX 加速,全部在用户个人的 Windows RTX PC 或工作站上本地运行,获得快速、安全的结果。

其在硬件方面主要就两点要求:

1、拥有8GB以上显存的RTX 30或RTX 40系列显卡。当然同规格的专业显卡也可以。

2、电脑内存超过16GB。

对于显卡来说,即使是2022年发布的RTX 3050也能满足相关需求。RTX 3050基本可以算是最近几年“游戏电脑”的基本配置了,所以目前很多现有的 “游戏电脑”都能符合这样的配置要求。

如果你想要部署其它本地大模型,硬件配置要求可能会稍微高一点。简单来说大模型参数越大,需要的显存就越多。假设你使用的显卡其显存大小为16GB,那么想要本地部署7B以下参数量级的大模型应该是问题不大的。

简单总结一下,这种部署模式有两个优点:

1、数据在本地计算,无需担心信息外泄。

2、大多数最近几年购买的“游戏电脑”基本都可以跑,不需要额外购置新设备。

通过AI PC本地部署大模型

早在2023年9月,英特尔CEO帕特·基辛格在硅谷提出了PC的革命性概念——AI PC。英特尔也是最先提出AI PC概念的厂商。AI PC简单来说就是能玩转AI功能的PC。

具体来说,AI PC集成了中央处理器(CPU)、图形处理器(GPU)和神经网络处理单元(NPU),每种处理器都具有特定的AI加速功能。NPU是一种专用加速器,它能高效地在PC上直接处理人工智能和机器学习(ML)任务,而不是将数据发送到云端进行处理。因此用AI PC跑AI也无需担忧信息外泄的风险。

相较于常规的游戏电脑,AI PC在轻薄与便携性方面展现出了显著的优势。这主要归因于游戏电脑通常需要配备独立显卡,而这类显卡不仅体积庞大,还需要配备庞大的散热模组来应对其散热需求,进而需要更高功率的电源来保障供电稳定。因此,游戏电脑在设计上往往显得更为厚重,便携性相对较差,而AI PC则能凭借其更为紧凑的设计,为用户提供更为轻便的使用体验。

所以对于工作中需要用到AI,且需要经常到处跑的人来说,AI PC会是个不错的选择。毕竟如果可以选的话,应该没多少人愿意背着“板砖”(游戏电脑)出门吧?

目前市面上的AI PC按所用处理器划分可以分成四个主要阵营,分别是苹果、英特尔、AMD、高通。

苹果:苹果在AI领域的布局其实挺早,只不过苹果似乎不太喜欢AI这个标签,搞出来的成果往往会以“机器学习”这类更细化的名字命名。比如苹果在2017年推出了Core ML框架,这是苹果为其开发者准备的机器学习框架。支持iOS、MacOS、tvOS和watchOS。也就说是在苹果生态内开发AI,基本不需要考虑兼容性等问题,可以按照统一的规范进行开发。另外苹果从M1芯片开始推出了“统一内存”的概念,使用统一内存跑大模型在带宽和容量方面会有明显优势。

英特尔:英特尔专为AI PC推出了英特尔酷睿Ultra处理器,在这款处理器中除了拥有CPU、GPU以外,还集成了用于客户端的片上AI加速器“神经网络处理单元(NPU)。不过需要说明的是,通常并不是只有NPU来处理AI应用,CPU、GPU也会承担对应的AI加速功能。

AMD:AMD的AI PC处理器利用了三种计算引擎:基于Zen架构的CPU、基于AMD RDNA的集成或独立GPU、以及基于AMD XDNA的AI引擎(NPU)。XDNA是该公司在收购Xilinx后提出的新架构。它是一种自适应数据流架构,被认为可以大幅度改变PC体验。AMD XDNA还可以优化AI算法运行效率,进而减少电耗。

高通:近期微软推出了基于高通骁龙 X Elite和骁龙 X Plus处理器的AI PC产品Surface Pro和Surface Laptop。微软的AI PC在宣传上似乎更偏向于“生态赋能”。具体来说,英特尔、AMD在宣传AI PC的时候往往会重点介绍AI的本地化部署优势。而微软似乎并不太在乎本地部署AI这件事。比如微软在发布会时重点介绍的C opilot,其中的不少功能是需要将数据上传的服务器进行处理,也就是相当于在走“云端AI”的路子。不过对于微软来说也可以理解,毕竟微软是一个系统厂商,它肯定还是希望推进Windows和C opilot生态的发展。

结语

1、对于想在电脑上尝鲜AI技术的人来说,类似ChatGPT、文心一言之类的“云端AI”是首先。毕竟价格便宜而且使用起来也很简便。

2、对于担忧信息外泄风险的人来说,基于现有硬件本地部署AI是个不错的选择。其优势在于无需额外购置设备,拥有一台“游戏电脑”通常就能满足需求。缺点在于这类“游戏电脑”往往缺乏便携性,不便于移动使用。

3、对于上班、出差,而且还需要使用AI的人来说,AI PC会是个不错的选择。毕竟AI PC普遍毕竟轻薄、便携,带AI PC出差可以显著减轻我们肩膀上的压力。