最近,经常有小伙伴后台咨询:Kimi怎么用?水平如何?如何写提示词?怎么优化提示词?有哪些创新玩法?如何本地化部署?

我想,不如干脆给大家写一个系列文章《Kimi使用,从入门到精通》。

万丈高楼平地起,为了照顾刚来的同学,我们先从常识讲起。

用12个问题带大家系统了解AI。

1、什么是AI?

AI,是Artificial Intelligence的缩写,翻译过来就是⼈⼯智能。

它是研究、开发用于模拟、延伸和扩展人的智能的理论、方法、技术及应用系统的一门技术科学,是新一轮科技革命和产业变革的重要驱动力量。

说人话就是,AI研究怎么让机器表现出智能,模仿人类甚至超越人类。

2、为什么要搞AI?

AI是新的革命性技术,业内普遍把它看作是第四次工业革命的关键技术。

前三次革命的主角分别是:蒸汽机、电和计算机。

今天,你会问自己“为什么我们需要电和计算机”这个问题吗?

AI的目标是模拟、延伸和扩展人类智能,并最终解放全人类。这个过程,不以任何个人意志为转移。

3、发展历程是怎样的?

AI这个词,并非这两年兴起。很多人对它的关键印象,可能都来自影视剧里的人物。

比如《2001太空漫游》里的“HAL 9000计算机”,《终结者》中的天网以及T-800、T-1000机器人,《生化危机》里的红后,《黑客帝国》里的杀毒程序“特工斯密斯”。在这些电影中,人工智能无一例外都扮演了反派。

T-800,来自《终结者1》

使得到现在,依然有不少人在担心,AI会不会干掉人类?硅基“生命”会不会取代碳基生物?

真实的AI产业发展,远比电影无趣得多。AI行业经历了相当长时间的沉寂,在上世纪70~80年代经历了两次“AI寒冬”,直到2022年Midjourney和ChatGPT-3.5出现后,AI才从理论进入应用,开始走进公众视野。

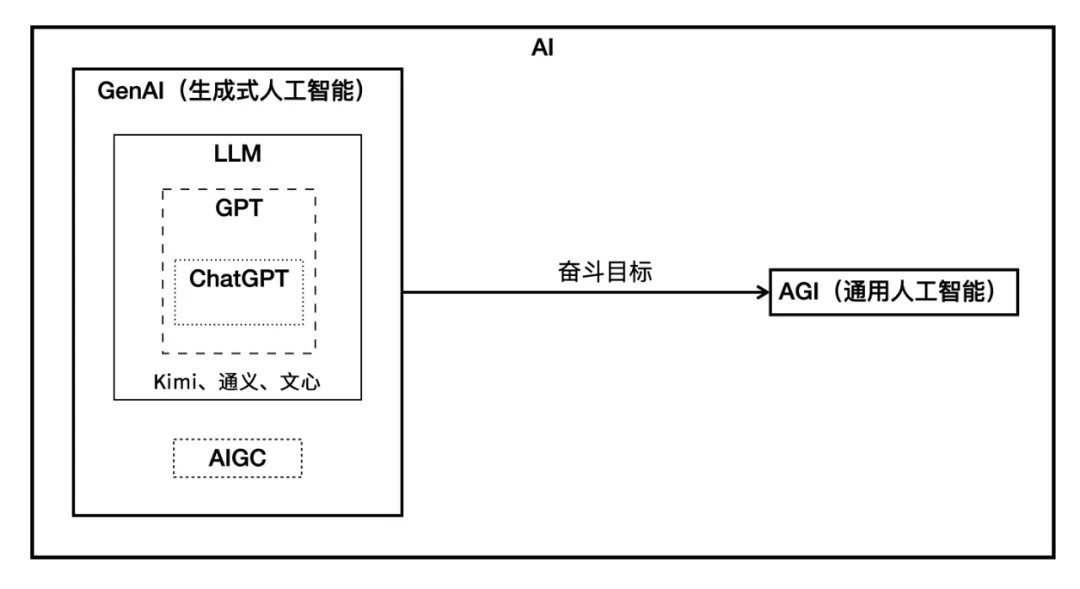

我总结了下,AI发展路径共有5个阶段:理论→计算机(算⼒、数据和算法)→深度学习→GenAI→AGI。

当前,我们正处于GenAI的时代。从GenAI到AGI,可能很长,也可能很快。

4、有哪些重要节点?

20世纪50年代,“图灵测试”、“神经网络”、“人工智能”概念提出,这是理论阶段。

20世纪70年代~21世纪,从PC到移动互联网,算力、数据和算法不断丰富,为AI诞生打下基础。

2015年,AlphaGo首次击败人类围棋职业选手,标志着深度学习取得了巨大突破,推动了自然语言处理(NLP)、机器视觉(CV)、语音识别(ASR)等领域的快速发展,如Siri、天猫精灵、小爱同学等ANI(弱人工智能)开始出现。

2015年12月11日,人工智能研究组织OpenAI在美国成立。

2017年Transformer架构、2020年Diffusion模型相继提出,为大模型带来了底层技术逻辑,生成式人工智能(GenAI)迅速涌现,标志事件是2022年11月30日OpenAI推出聊天机器人ChatGPT-3.5。

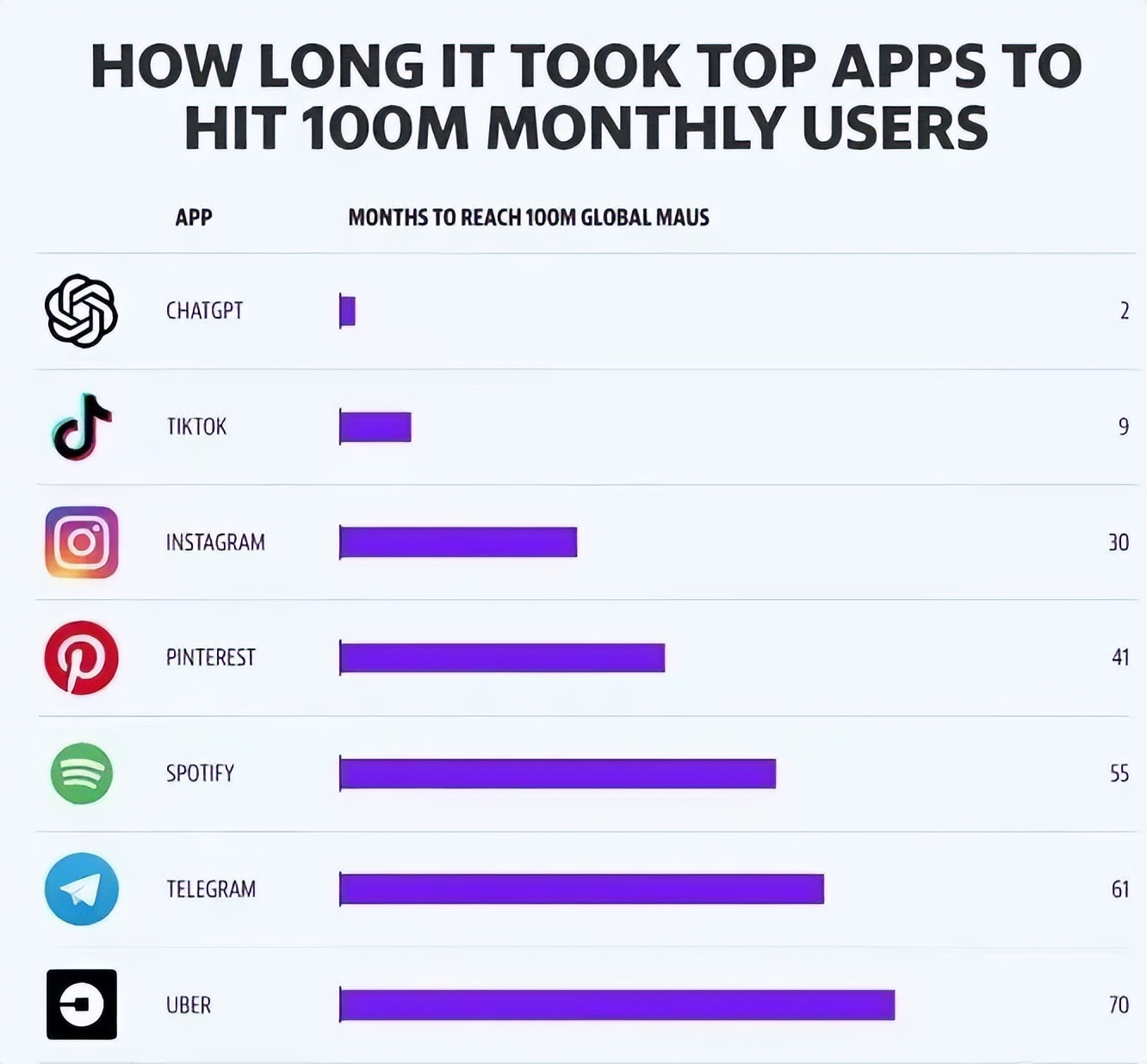

2023年3月14日,OpenAI发布GPT-4。ChatGPT成全球用户最快破亿的应用,用时不到2个月。

5、为什么要强调GenAI?

AI的终极目标,是建立通用人工智能(AGI),让AI可以执行人类交代的任何任务。

而想要实现AGI,生成式人工智能(GenAI)是不可或缺的一步。

GenAI是先行者,是通往AGI的重要实验平台,可以借此探索和验证通向AGI的关键技术和理念。

6、GenAI的底层技术

2017年,谷歌八子发表论文《Attention Is All You Need》,提出了基于multi-head(多头)自注意力机制的深度学习架构Transformer,为大语言模型奠定了基础。

2020年,Denoising Diffusion Probabilistic Models (DDPM扩散模型)提出,为文生图模型提供了方向,生成的效果越来越逼真。

Transformer架构+Diffusion模型,他们共同奠定了如今的GenAI浪潮。

7、AGI是什么?什么又是ANI?

AGI的定义,Artificial General Intelligence(通用人工智能),大家都比较统一。

但AGI是什么?行业内还未明确。OpenAI的首席科学官Ilya表示他没有见到AGI,OpenAI也没有见到。黄仁勋则表示会在10年内见到AGI。

一般认为,满足AGI需要符合这几个特征:自动化、自适应、多模态、高级推理。

理论上,AGI能够执行人类可以执行的任何任务,并比人类表现得更好。

最理想的AI模型:可以输入任何形式、任何场景的训练数据,可以学习到几乎“所有”的能力,可以做任何需要做的决策。

与之相对应的,则是ANI(弱人工智能),只能解决某项特定任务。比如AlphaGo只能下围棋,它是ANI。

ANI,如今已在我们的很多领域进行了应用。比如苹果的Siri、抖音的算法推荐、特斯拉的FSD智驾、高德地图的红绿灯预测等。

8、GenAI、大模型、AIGC,他们之间是什么关系?

GenAI,也就是生成式人工智能(Generative Artificial Intelligence),是当前主流的AI技术,能够使用生成式模型,生成文本、图像、音频、视频和其他数据。

大语言模型,即Large Language Model(LLM),是一种基于机器学习和自然语言处理技术(NLP)的语言模型,它通过对大量的文本数据进行训练,来学习人类语言的理解和生成能力。

传统LLM对自然语言的处理,是用RNN和CNN。Transformer架构提出后,业内便全部转为了Transformer架构。

大模型,是GenAI的一种具体实现形式,主要针对自然语言处理领域,比如文本方面。

GenAI除了文本生成外,还包括图像生成、音频生成和视频生成等。

AIGC,即Artificial Intelligence-Generated Content,是GenAI生成的具体内容,是结果。

9、GenAI有哪些形式?

目前,GenAI主要有这几种形式:

1)文生文,text to text,典型应用如GPT、Kimi、通义千问等;

2)文生⾳频,text-to-audio,如AI音乐Suno、SkyMusic、讯飞听见等;

3)文生图/图⽣图,text-to-image,如Midjourney、Dalle3、美图MiracleVision等;

4)图⽣视频/文生视频/文生图再生视频,text-to-video,如Sora、PixVerse、Dreamina等。

10、GenAI有什么优缺点?

优点:

1)能用自然语言与机器交互。说大白话就是,电脑能直接听懂你说的话(支持文字、语音、图片多模态),而不需要通过编程语言或特定按钮来交互。

2)学习力惊人。各家大模型基本都训练了上千亿甚至上万亿的参数,已学习了全球互联网上的海量语料。

3)有一定的记忆力。主流的大模型均支持10轮以上的连续性对话,能结合用户问题的上下文进行回答。

4)有一定的推理能力。只能是“一定”,强推理能力目前还做不到。

5)多模态。各家大模型,正在逐步支持文本、视觉、语音甚至视频等多感官的交互。

缺点:

1)内容是生成的,不是标准答案。在面对开放性问题时,大模型的回答没有问题;但涉及垂直行业或唯一结果指向的问题时,AI会胡编乱造。

2)幻觉问题。由于AI的回答是生成的,导致幻觉问题经常发生,容易一本正经的胡说八道。

3)对齐。需要提问的人自己也是专业的,这样才能鉴别AI回答的真伪与靠谱程度。

4)对算力依赖。大模型就不说了,烧的是平台的算力。但是对于一些需要本地化部署的图片、视频AI,个人DIY依然很耗算力,经常需要1张H100显卡(售价25万元rmb)才能入门。

5)黑箱操作。大模型基本都是“黑箱”操作,开箱即食,其决策过程难以解释,无法满足透明度和可追溯的应用场景(如法律、医疗决策)。

11、当前的GenAI能做什么?

目前的AI,还无法做到通用解决,但已经能够在我们工作的具体环节进行替代或辅助工作,而且效率惊人。

需要我们学会使用不同的AI工具,来解决工作中的各项具体问题。

12、主流GenAI应用有哪些?

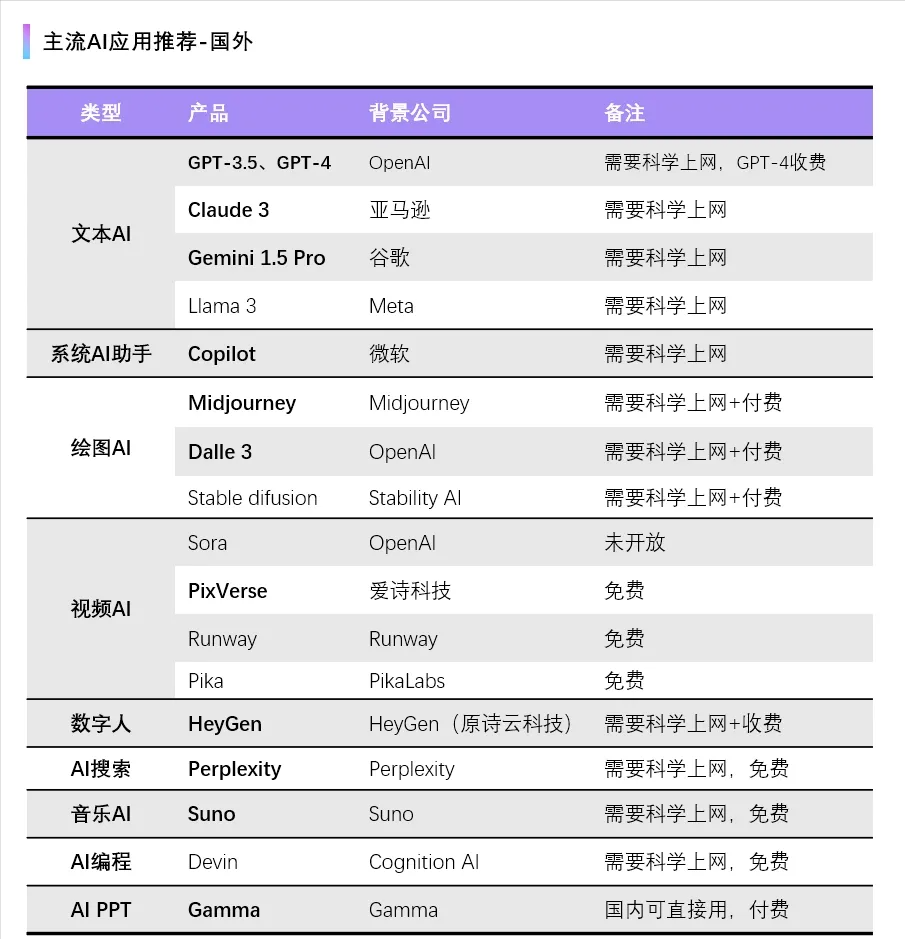

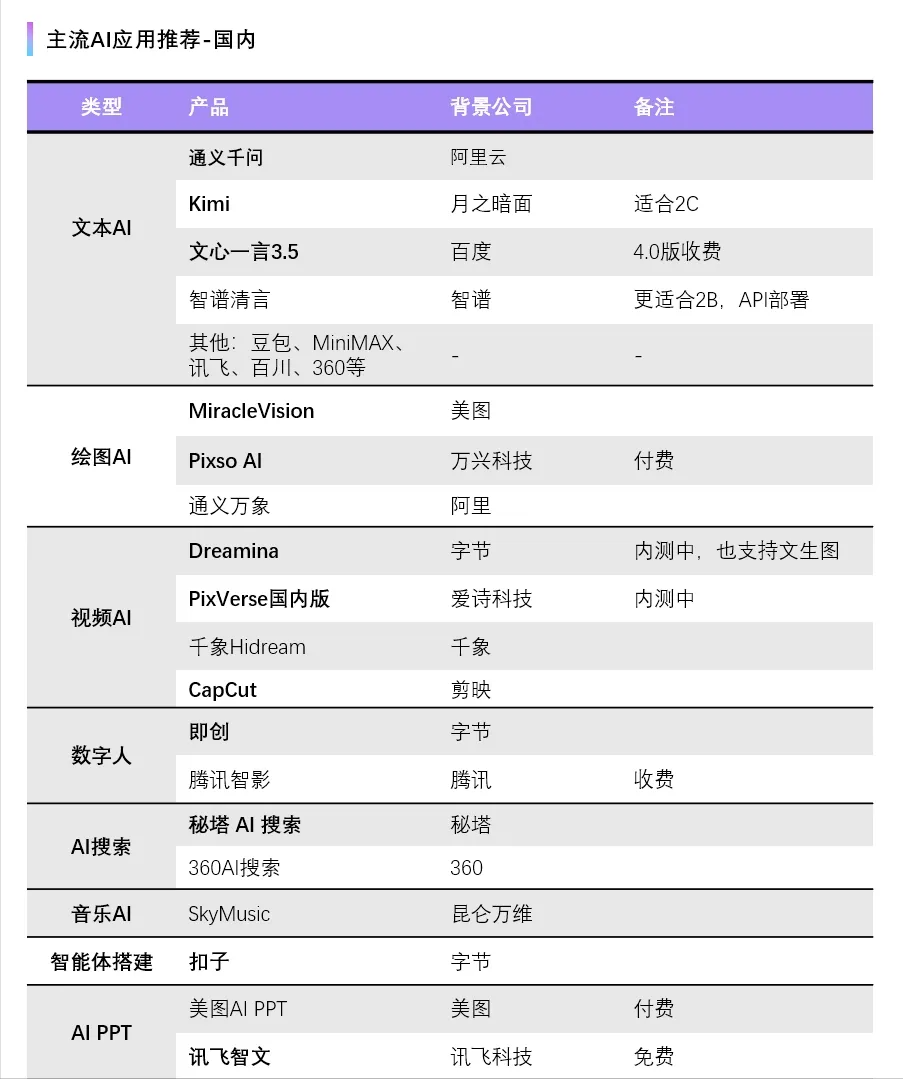

针对国内外网,重点推荐的一些AI应用。加粗的,为重点推荐。